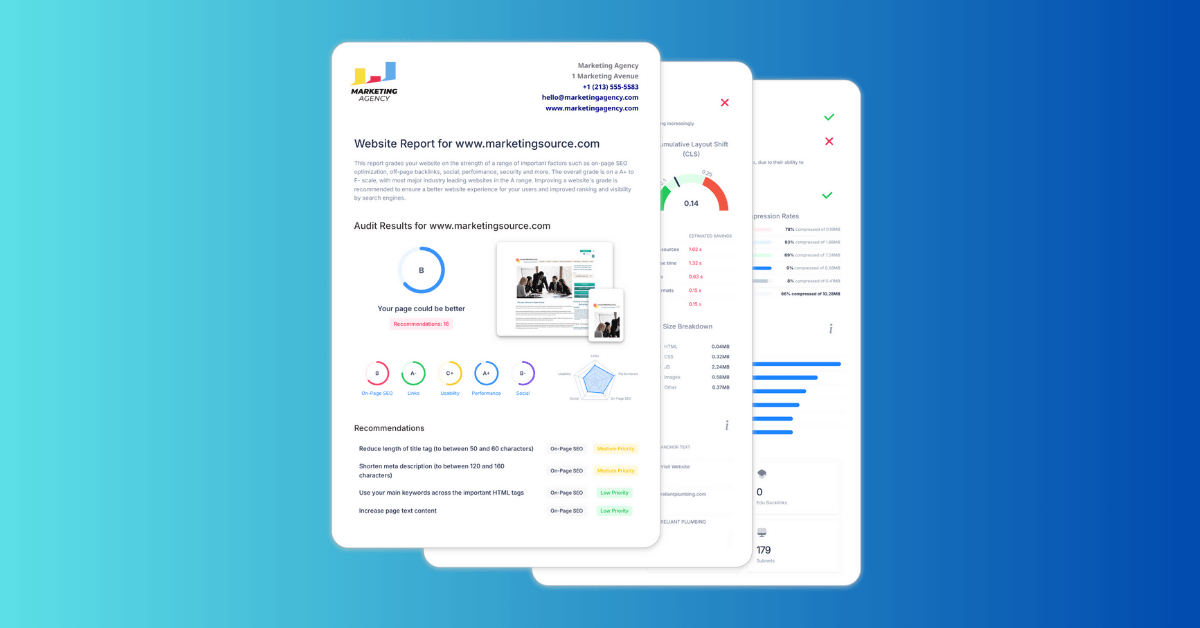

Der SEO-Crawler von SEOptimer hilft Ihnen, die Seiten auf Ihrer Website zu scannen und zu überprüfen, um technische SEO-[Probleme] in großem Maßstab zu identifizieren.

Statt Seiten einzeln zu überprüfen, überprüft der Crawler Ihre Website-Struktur, analysiert SEO-Elemente über mehrere URLs hinweg und hebt [Probleme] hervor, die sich auf die Indexierung, [Benutzerfreundlichkeit] oder Sichtbarkeit in der Suche auswirken können.

In diesem Leitfaden werden Sie:

- "Führen Sie Ihren ersten Crawl durch"

- "Überprüfen Sie den Crawl-Bericht"

- "Lernen Sie, wie man benutzerdefinierte Crawl-Regeln einrichtet"

- "Planen und exportieren Sie Website-Crawls"

Was ist der SEO-Crawler von SEOptimer?

Der SEO-Crawler von SEOptimer ist ein Website-Crawling-Tool, das die Seiten Ihrer Website scannt und SEO-bezogene [Probleme] über mehrere URLs identifiziert.

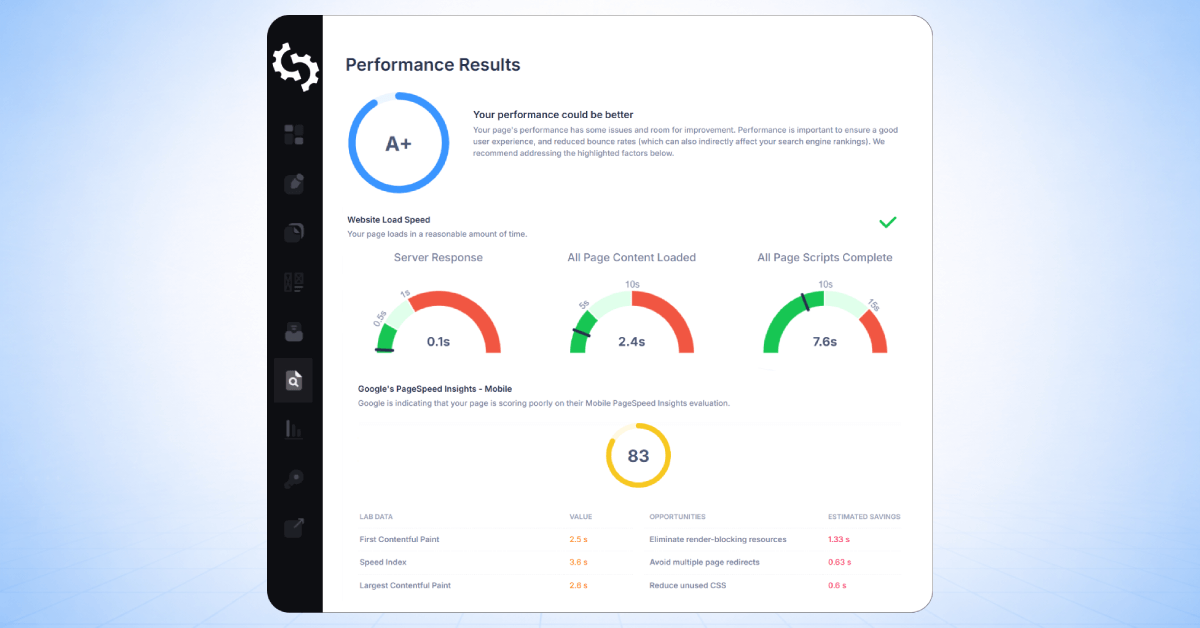

Es funktioniert, indem es Seiten auf Ihrer Website besucht und technische und On-Page-SEO-Daten wie "Seitentitel", "Meta-Beschreibungen", "Überschriften", "Statuscodes", "Indexierbarkeit", "Weiterleitungen" und "defekte Links" sammelt.

Nach Abschluss des Crawls erstellt das Tool einen Crawl-Bericht, der die auf Ihrer Website gefundenen "Probleme" zusammenfasst und sie nach "Typ" und "Schweregrad" gruppiert.

Dies macht es einfacher, wiederkehrende [Probleme] zu erkennen und [Korrekturen] zu priorisieren, insbesondere auf größeren Websites, wo manuelle Seitenüberprüfungen nicht praktisch sind.

Der SEO Crawler ist nützlich für das Durchführen von technischen SEO-Audits, die Überwachung der "Website-Gesundheit" im Laufe der Zeit und die Überprüfung, ob wichtige Seiten den [SEO-Best-Practices] folgen.

Wie Sie Ihren ersten "Crawl" ausführen

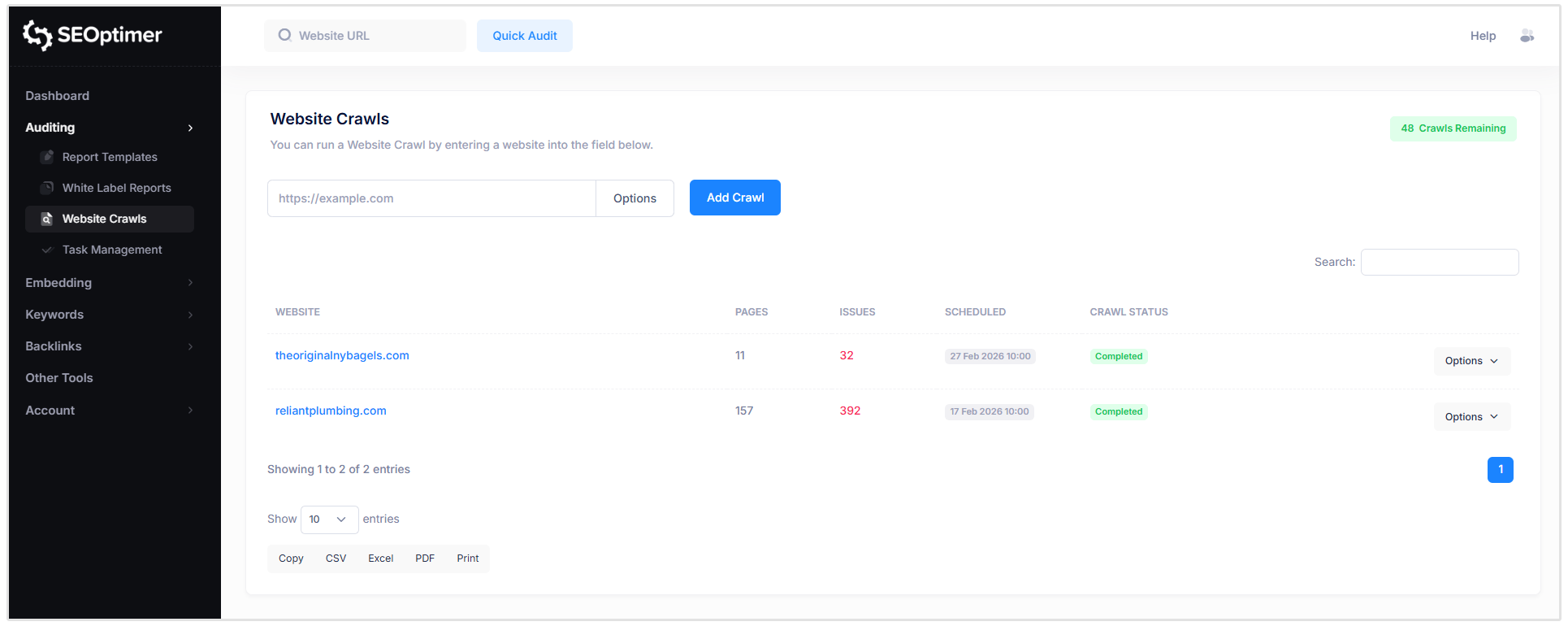

Um Ihren ersten Crawl durchzuführen, klicken Sie auf die Option „Website Crawls“ unter „Auditing“ in Ihrem SEOptimer-Dashboard.

Fügen Sie dann die URL Ihrer Website in das offene Feld ein und klicken Sie auf “Crawl hinzufügen.”

Das war's, Sie haben Ihren ersten SEOptimer-Website-Crawl gestartet!

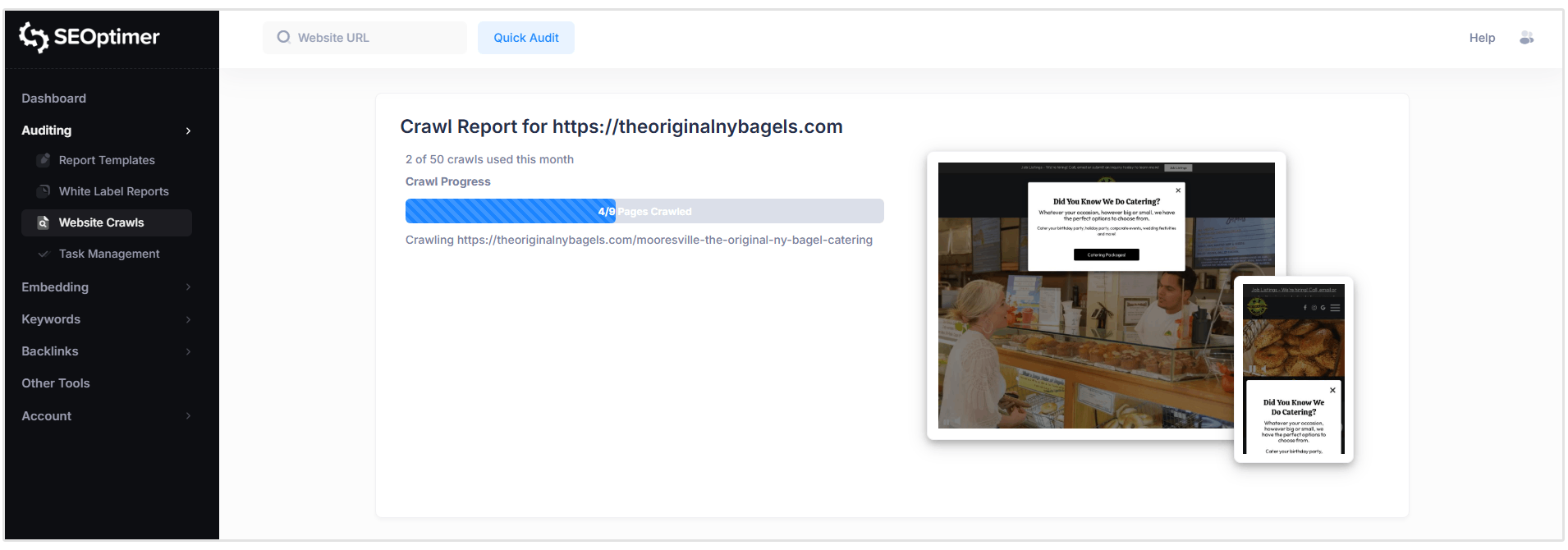

Unser SEO-Crawler wird nun alle Seiten Ihrer Website durchgehen, um eventuelle [Probleme] zu erkennen.

Durchläufe werden in Echtzeit ausgeführt, aber die gesamte Durchlaufzeit variiert je nach Größe Ihrer Website und der Anzahl der Seiten, die gescannt werden müssen.

Während der Crawl noch läuft, können Sie beginnen, "Probleme" zu überprüfen, sobald sie erkannt werden, indem Sie den Crawl-Bericht öffnen.

Was können Sie in jedem Crawl-Bericht [sehen]?

Sobald unser Tool das Crawlen Ihrer Website abgeschlossen hat, sehen Sie drei Hauptabschnitte:

- Berichtskopf

- Identifizierte Seiten

- Problemazusammenfassung

Lassen Sie uns jeden dieser Abschnitte durchgehen.

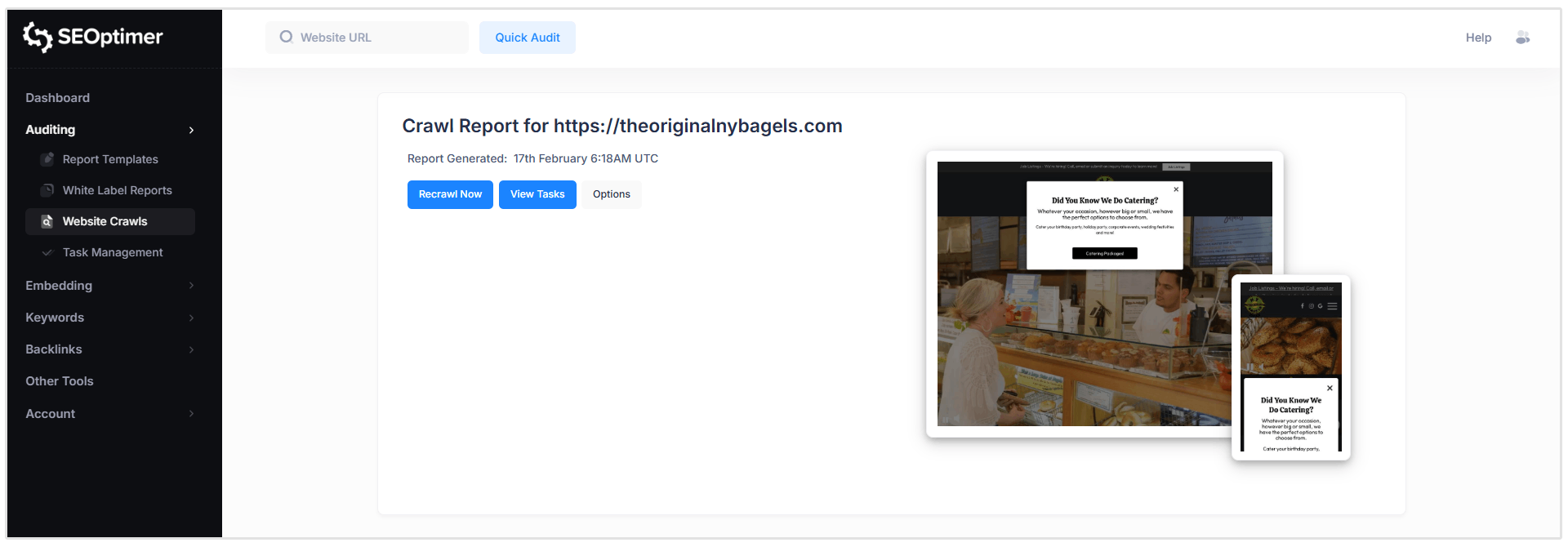

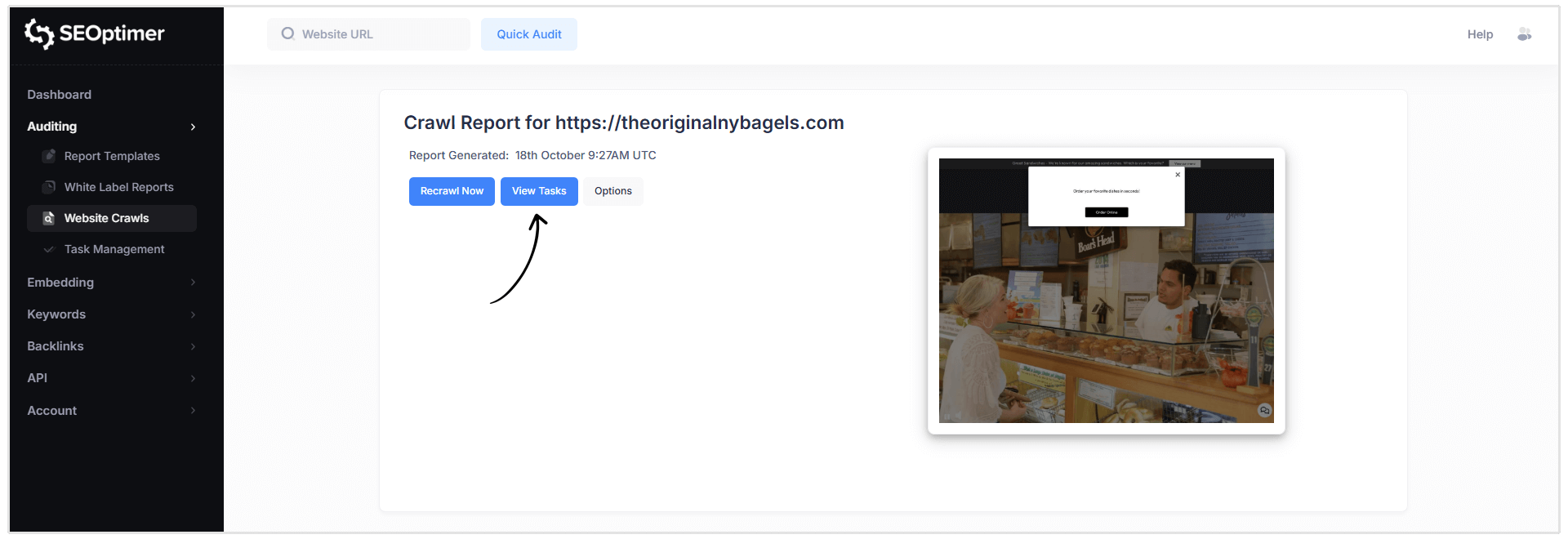

Berichtskopf

Hier sehen Sie, wann der Bericht erstellt wurde, können eine erneute Durchsuchung anfordern, Aufgaben anzeigen und Crawl-Regeln anpassen. (mehr zu diesen Funktionen später)

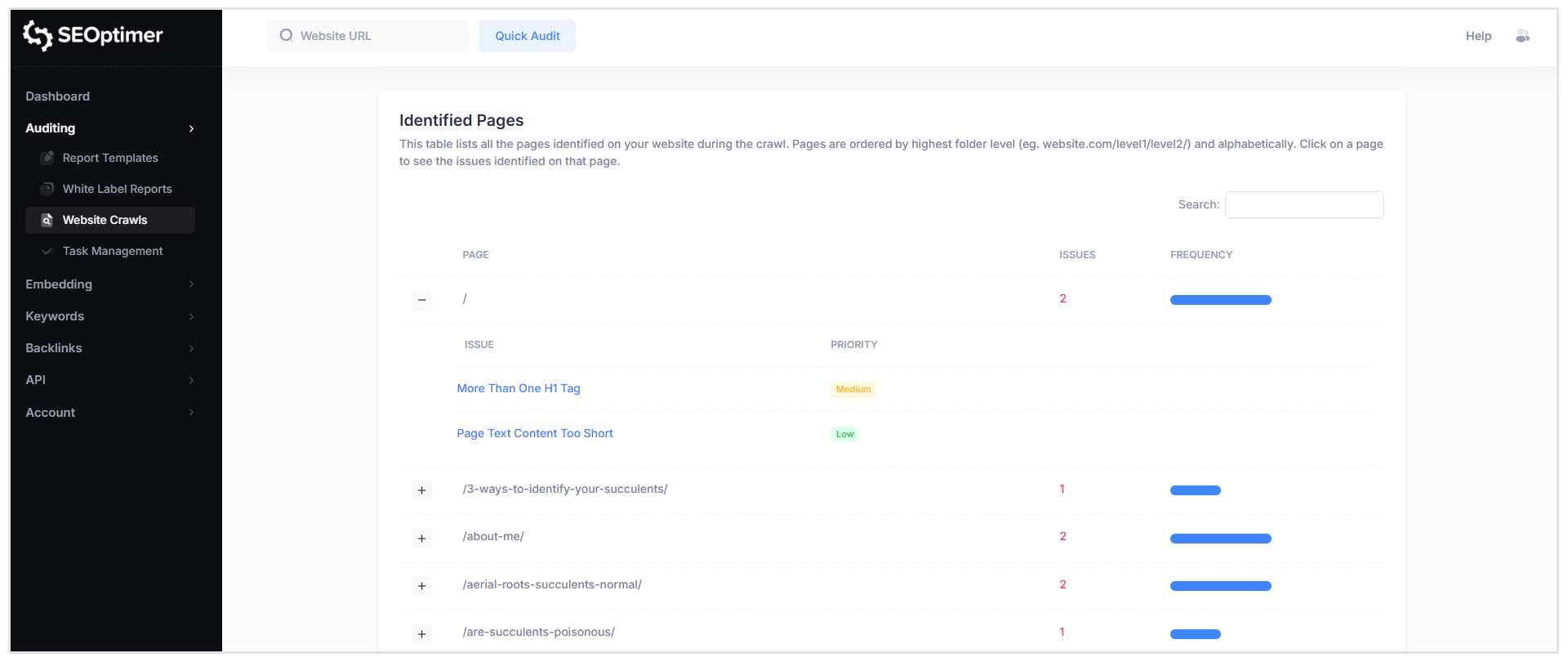

Identifizierte Seiten

Dieser Abschnitt zeigt eine Tabelle aller während des Crawls entdeckten Seiten sowie die für jede Seite erkannten SEO-Probleme.

Wenn Sie auf eine bestimmte Seite klicken (zum Beispiel den Root-Homepage-Pfad, der als “/” angezeigt wird), sehen Sie eine Liste aller [Probleme], die für diese URL markiert sind, einschließlich des [Schweregrads] jedes [Problems].

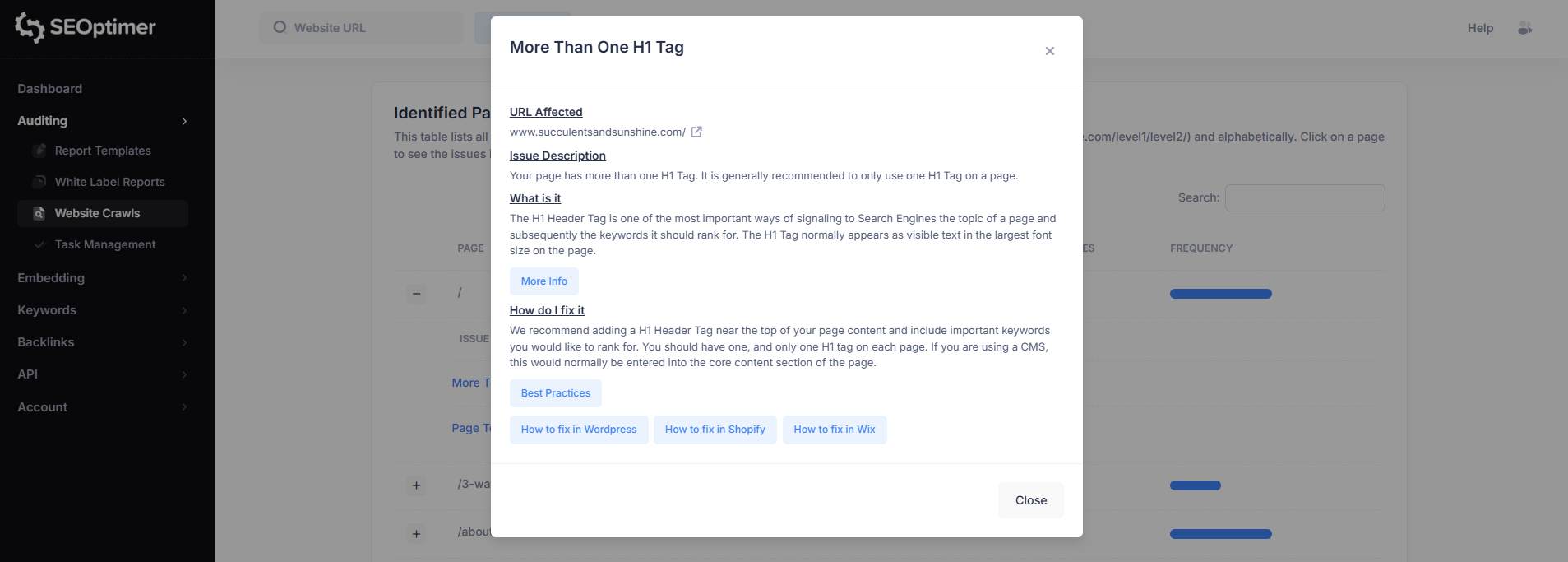

Um weitere Details zu sehen, klicken Sie auf ein beliebiges [Problem] in der Liste.

Zum Beispiel wird die Auswahl von “Mehr als ein H1-Tag” eine detaillierte Aufschlüsselung dieses Problems für die ausgewählte Seite öffnen.

Diese "issue view" [enthält]:

- Betroffene URL

- [Beschreibung] des [Problems]

- Was das [Problem] bedeutet

- Wie man es behebt

Jedes "Problem-Pop-up" enthält auch Links zu unterstützenden "Guides", um Ihnen zu helfen, das [Problem] auf Ihrer Website zu lösen.

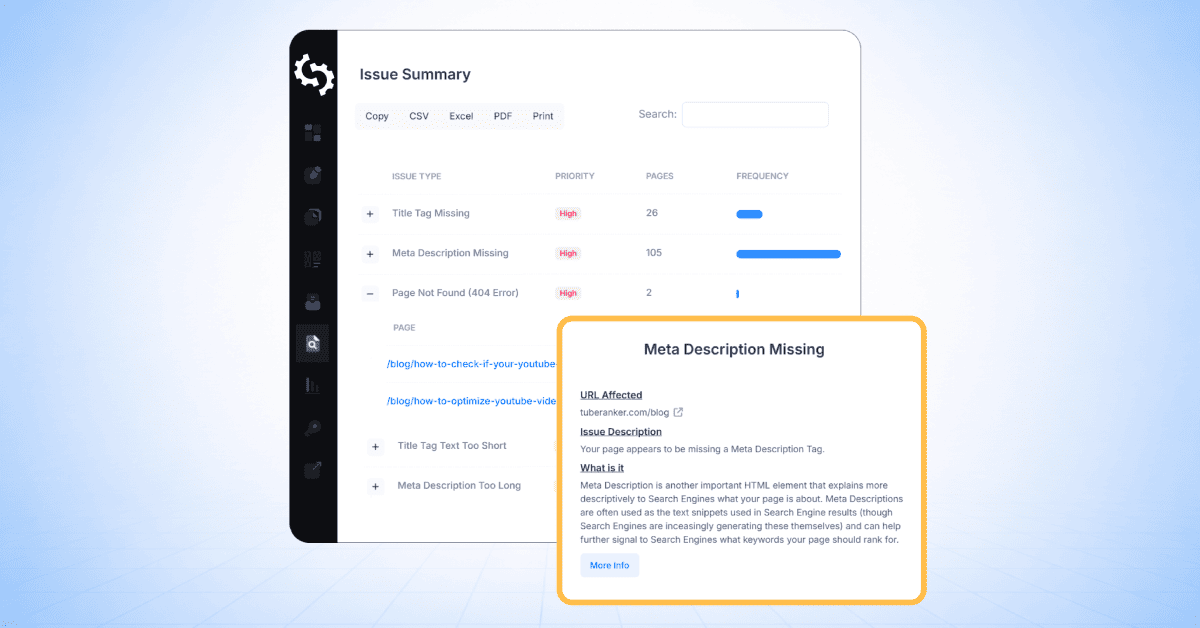

Problembeschreibung

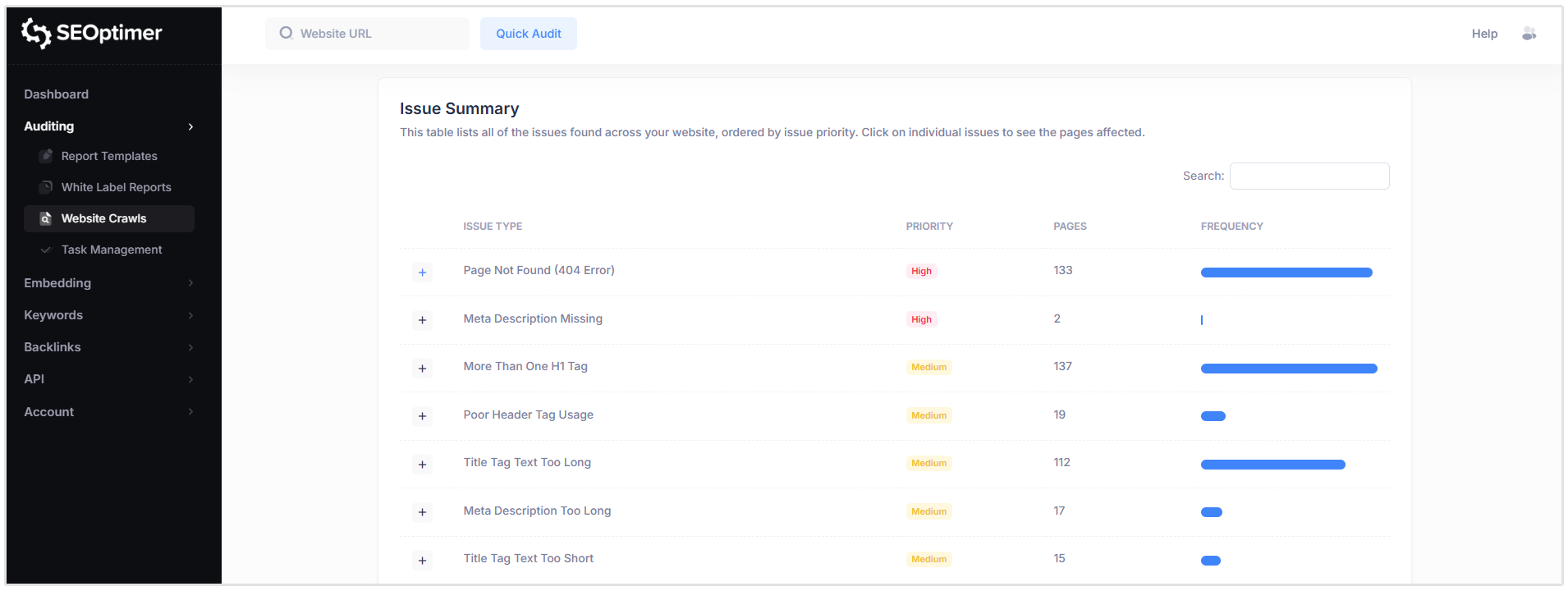

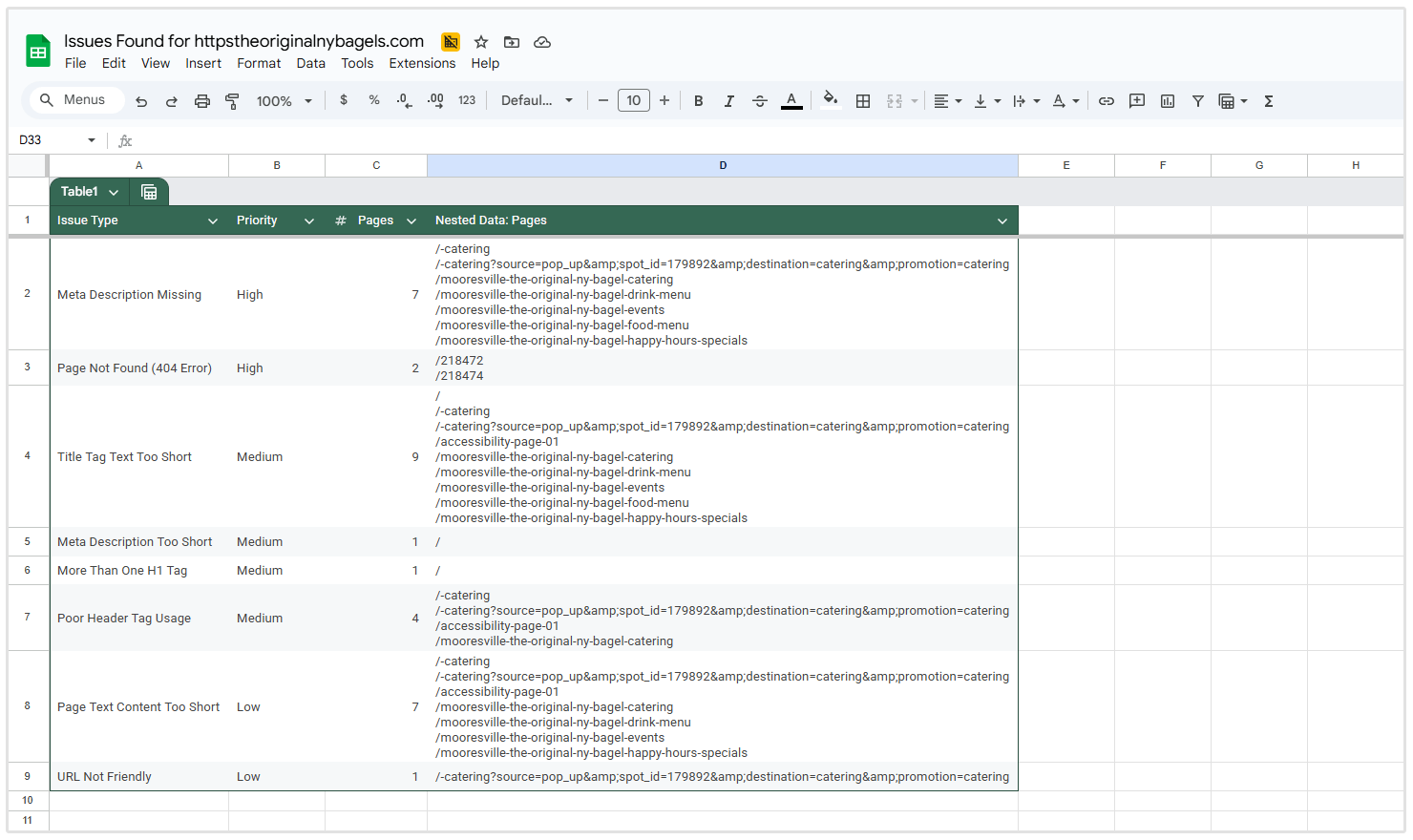

Der Abschnitt "Zusammenfassung der Probleme" bietet einen Überblick über alle auf Ihrer Website erkannten SEO-Probleme, gruppiert nach [Problemtyp] und geordnet nach Priorität.

Für jedes "Problem" zeigt die Tabelle:

- "Problemtyp"

- "Prioritätsstufe"

- "Anzahl der betroffenen Seiten"

Also im untenstehenden Screenshot einer Website, die ich durchsucht habe, sehen Sie, dass es 137 Seiten gibt, die mehr als einen H1-Tag haben, 133 Seiten, die 404-Fehler haben, und 2 Seiten, die keine Meta-Beschreibung haben.

Sobald Sie die Zusammenfassung des Problems überprüft haben, können Sie mit der Konfiguration der Crawl-Einstellungen fortfahren und zusätzliche Optionen des SEO Crawlers erkunden.

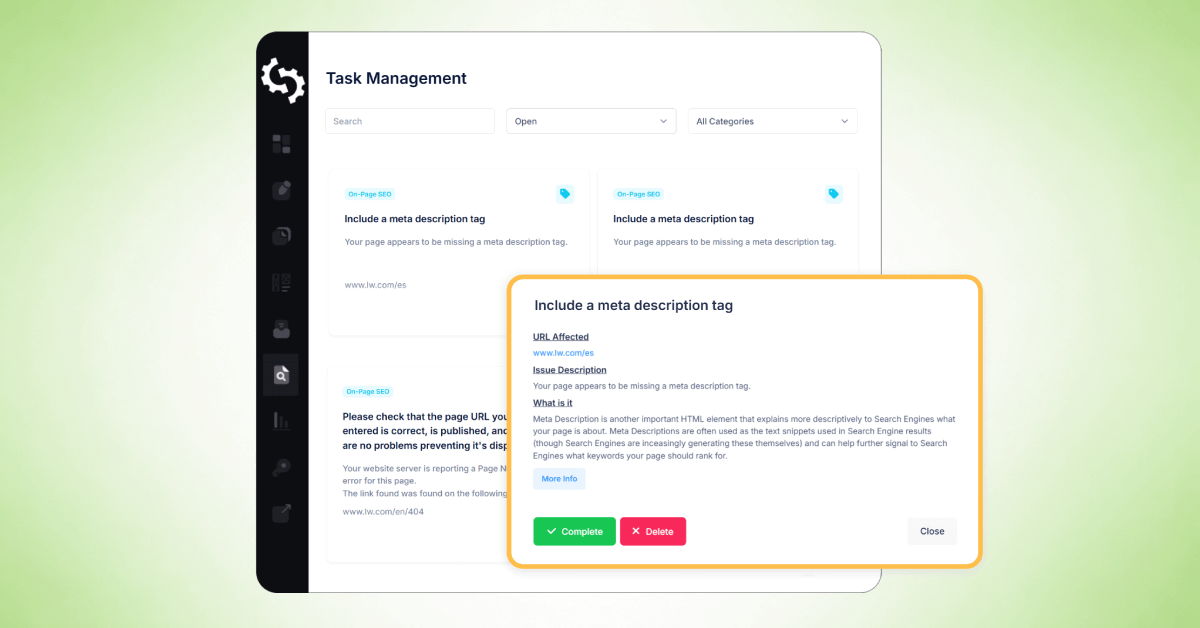

Aufgaben anzeigen

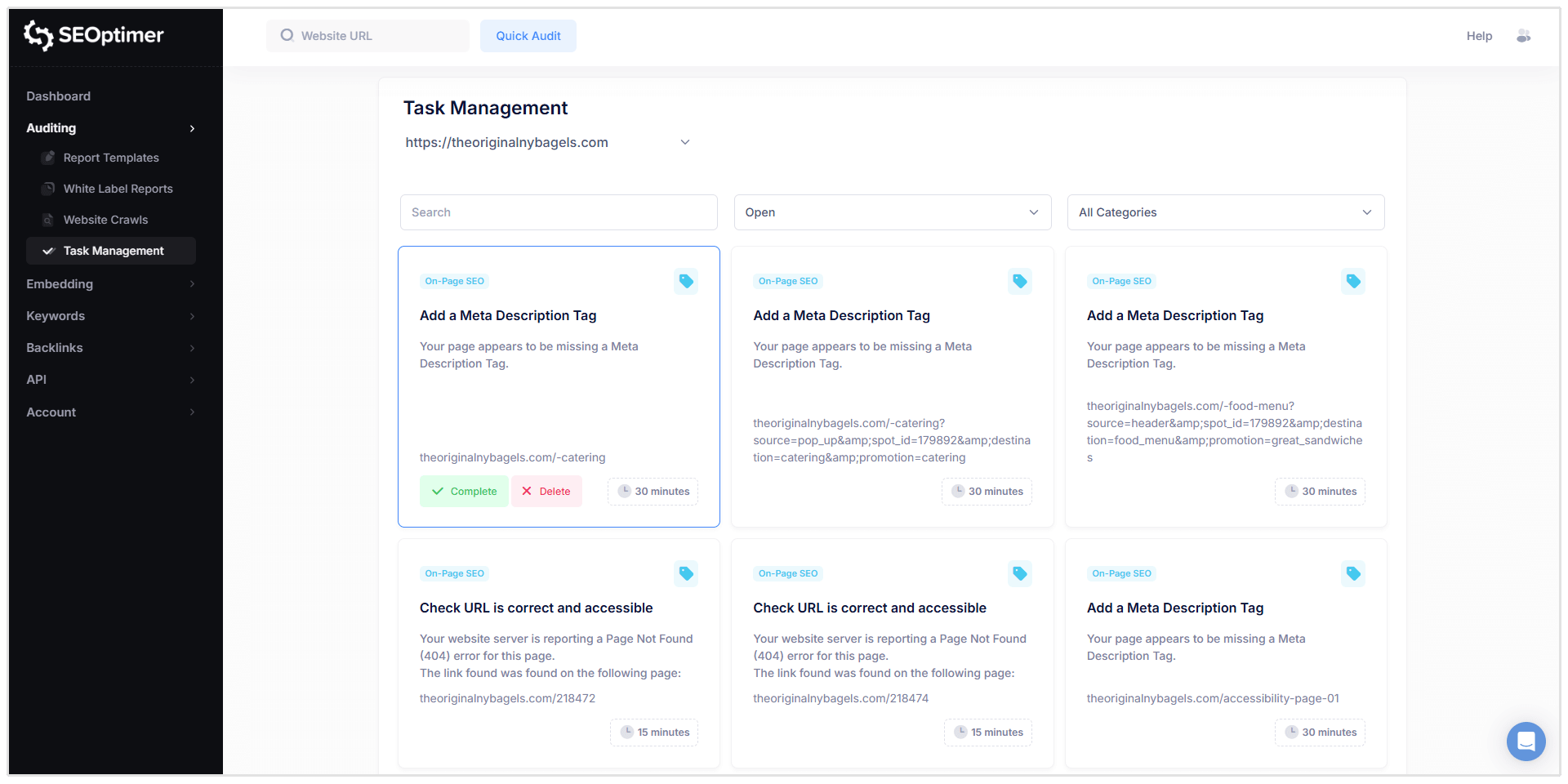

Nach Abschluss eines Website-Crawls können Sie die "Task Management"-Funktion von SEOptimer verwenden, um die in Ihrem Crawl-Bericht identifizierten [issues] zu organisieren und zu verfolgen.

Das Tool für "Task Management" wandelt Crawl-Probleme in eine Aufgabenliste um, die Sie in einem einzigen Arbeitsbereich abarbeiten können, was es einfacher macht, Korrekturen zu priorisieren und den Fortschritt im Laufe der Zeit zu verfolgen.

Wie man auf die "Task List" zugreift

Sie können Ihre Aufgabenliste auf zwei Arten öffnen:

- Klicken Sie auf die blaue Schaltfläche „Aufgaben anzeigen“ im Header des Crawl-Berichts.

- Oder wählen Sie [Aufgabenverwaltung] aus dem Navigationsmenü auf der linken Seite Ihres Dashboards.

Hinweis: Wenn Sie mehrere Websites durchsucht haben, können Sie mit dem Dropdown-Menü oben auf der Seite "Aufgabenverwaltung" zwischen Aufgabenlisten wechseln.

Filtern und Verwalten von Aufgaben

Aufgaben können gefiltert werden nach:

- Status (Offen, Abgeschlossen, Gelöscht)

- Kategorie (z. B. On-Page SEO, Links, etc.)

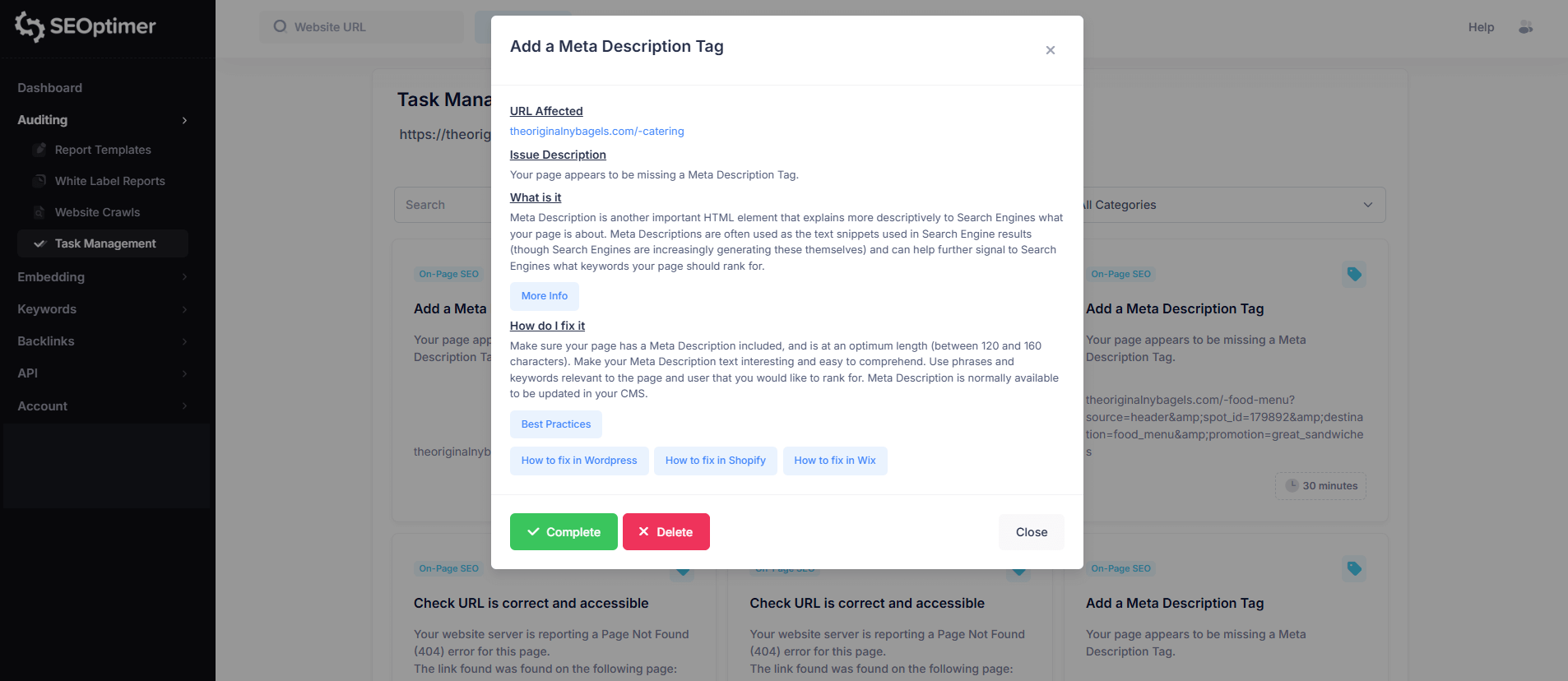

Wenn Sie auf eine Aufgabe klicken, sehen Sie detaillierte Informationen ähnlich wie im Crawl-Bericht, einschließlich:

- Betroffene URL

- Problembeschreibung

- Was das [Problem] bedeutet

- [Wie] es behoben werden kann

- [Optionen], um die Aufgabe abzuschließen oder sie von der Aufgabenliste zu löschen

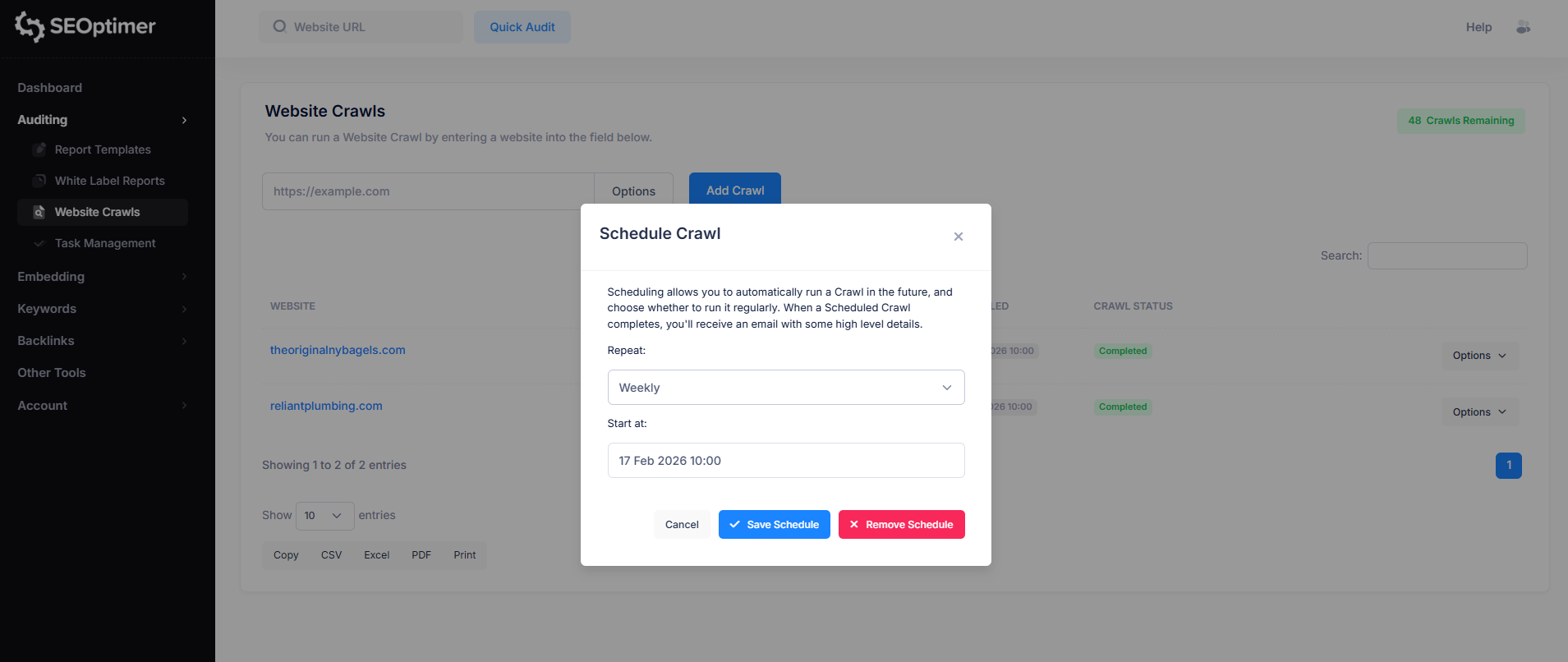

Wie man "Crawls" [plant]

Sie haben auch die Möglichkeit, "Crawls" so zu planen, dass sie wöchentlich oder monatlich ausgeführt werden. Diese Funktion ist besonders nützlich für Agenturen, die mehrere [Client]-Websites verwalten.

Um einen Crawling-Zeitplan einzurichten, klicken Sie einfach auf die “Optionen”-Schaltfläche rechts von der Website, für die Sie einen Crawl planen möchten.

Dann klicken Sie auf die Option “Zeitplan” und passen Sie den Crawl-Zeitplan nach Ihren [Vorlieben] an.

Wenn ein geplanter Crawl abgeschlossen ist, erhalten Sie eine E-Mail mit einigen "high level"-Details.

Festlegen Ihrer eigenen Crawl-Regeln

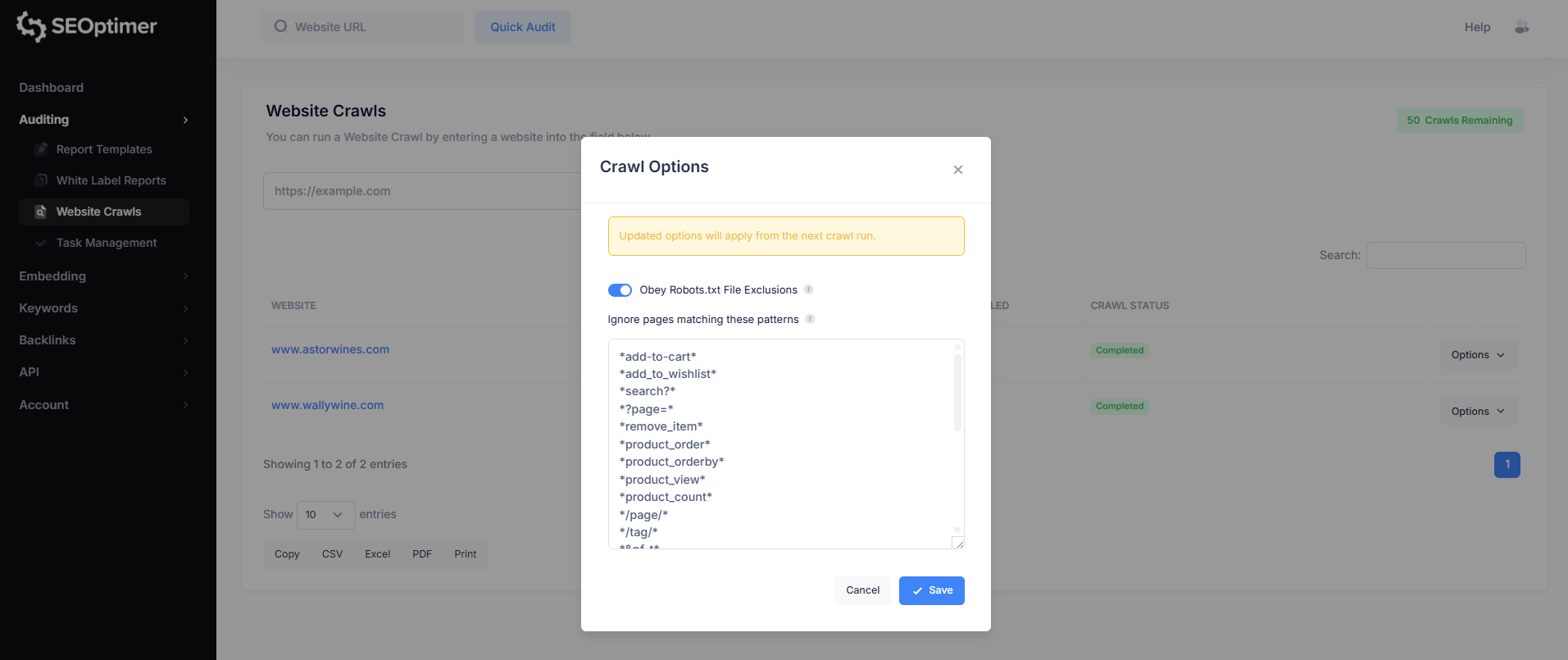

Der SEO Crawler enthält Konfigurationsoptionen für das Crawlen, die es Ihnen ermöglichen, zu steuern, welche Seiten in einen "Crawl" einbezogen werden.

Diese Einstellungen sind nützlich, wenn Sie die Ergebnisse "begrenzen", doppelte URLs vermeiden oder sicherstellen möchten, dass der Crawler sich im Einklang mit den Indexierungsregeln Ihrer Seite verhält.

Robots.txt-Ausschlüsse "befolgen"

Standardmäßig kann der Crawler den in der robots.txt-Datei Ihrer Website definierten Regeln folgen. Dies bestimmt, ob der Crawler Seiten meiden soll, die als nicht erlaubt markiert sind.

- Aktiviert (empfohlen): Der Crawler wird "robots.txt"-Ausschlüsse beachten und gesperrte Seiten überspringen.

- Deaktiviert: Der Crawler wird "robots.txt"-Regeln ignorieren und versuchen, alle Seiten zu crawlen, auf die er zugreifen kann.

In den meisten Fällen wird empfohlen, "robots.txt" zu befolgen, insbesondere wenn "Crawls" auf Live-Produktionsseiten ausgeführt werden.

Seiten ignorieren, die diesen Mustern entsprechen

Einige Websites erstellen mehrere Versionen derselben Seite mithilfe von URL-Parametern (zum Beispiel "Sortierung", "Filterung", "Paginierung" oder "Tracking-Codes").

Dies ist besonders häufig auf "E-Commerce-Websites".

Die “Seiten ignorieren, die diesen Mustern entsprechen” [Option] ermöglicht es Ihnen, diese doppelten oder wenig wertvollen URLs vom Crawlen auszuschließen. Dies hilft, die Crawling-Ergebnisse sauberer zu halten und macht die Berichterstattung über [Probleme] leichter überprüfbar.

Dies ist eine [fortgeschrittene] "Funktion" und ist hauptsächlich [nützlich] für Websites mit einer großen Anzahl von parameterbasierten URLs.

SEOptimer enthält ein Standardsatz von Ausschlussmustern, um häufige duplikate Parameter-basierte [duplicates] herauszufiltern, aber Sie können bei Bedarf Ihre eigenen Regeln hinzufügen.

Diese Muster folgen der standardmäßigen robots.txt-Abgleichssyntax.

Wenn Sie mit den Regeln von robots.txt oder der URL-Mustererkennung nicht vertraut sind, wird empfohlen, die Grundlagen zu [überprüfen], bevor benutzerdefinierte Ausschlüsse für das Crawlen hinzugefügt werden. Falsche Muster können verhindern, dass wichtige Seiten gecrawlt werden.

Hier sind einige nützliche "Referenzen":

- Robots.txt - Der Ultimative Leitfaden

- Einführung und Leitfaden zu Robots.txt | Google Search Central

- Wie Google die "robots.txt"-Spezifikation interpretiert

- Robots.txt [Syntax]

Wie man "Crawl-Daten" exportiert

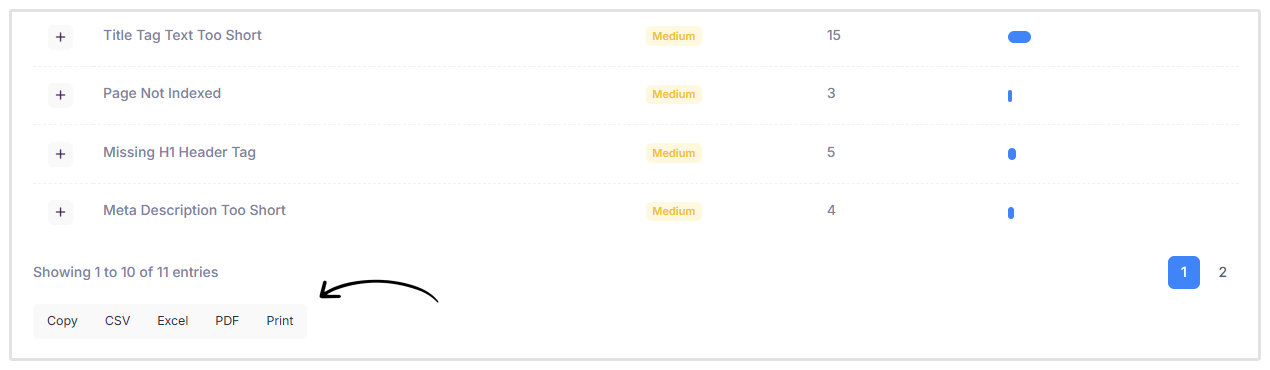

Jeder Tabelle im SEO Crawler-Bericht enthält integrierte Exportoptionen, die es Ihnen ermöglichen, Crawl-Ergebnisse außerhalb der Plattform herunterzuladen oder zu teilen.

Am unteren Rand jeder Tabelle sehen Sie Export-Schaltflächen, mit denen Sie die Daten in verschiedenen Formaten ausgeben können:

- CSV: Laden Sie die Tabelle als .csv-Datei herunter (nützlich für "Tabellenkalkulationen" und "Datenverarbeitung").

- Excel: Exportieren Sie die Tabelle als Excel-Datei für "Berichterstattung" oder weitere Analyse.

- PDF: Erstellen Sie eine PDF-Version der Tabelle zum "Teilen" oder zur "Dokumentation".

- Drucken: Öffnen Sie eine druckerfreundliche Version der Tabelle.

Exporte gelten für die spezifische Tabelle, die Sie sich ansehen, wodurch es einfach ist, "Problemlisten", "Seitenberichte" oder gefilterte Ergebnisse nach Bedarf herunterzuladen.

Zusammenfassung

Der SEO-Crawler von SEOptimer macht es einfach, technische und On-Page-SEO-Probleme auf Ihrer gesamten Website in einem einzigen Crawl zu identifizieren.

Durch die Überprüfung des Crawl-Berichts und die Verwendung der integrierten Aufgabenliste können Sie Crawl-Ergebnisse schnell in umsetzbare "Verbesserungen" umwandeln.

Für beste Ergebnisse sollten Sie regelmäßige Crawls in Betracht ziehen, um Änderungen im Laufe der Zeit zu überwachen und neue Probleme zu erkennen, während Ihre Website wächst.

Brauchen Sie Hilfe?

"Live-Chat": Klicken Sie auf "Live-Chat" (unten rechts)

Email: [email protected]

Antwortzeit: Innerhalb von 24 Stunden