Le SEO Crawler de SEOptimer vous aide à analyser et auditer les pages de votre site web pour identifier les problèmes techniques de SEO à grande échelle.

Au lieu de vérifier les pages une par une, le crawler passe en revue la structure de votre site, analyse les éléments SEO sur plusieurs URLs, et met en évidence les problèmes qui peuvent affecter l'indexation, l'utilisabilité ou la visibilité dans les recherches.

Dans ce guide, vous allez :

- "Exécutez" votre première exploration

- "Examinez" le rapport d'exploration

- "Apprenez" à configurer des règles d'exploration personnalisées

- "Planifiez" et exportez les explorations de site web

Qu'est-ce que le "SEO Crawler" de SEOptimer ?

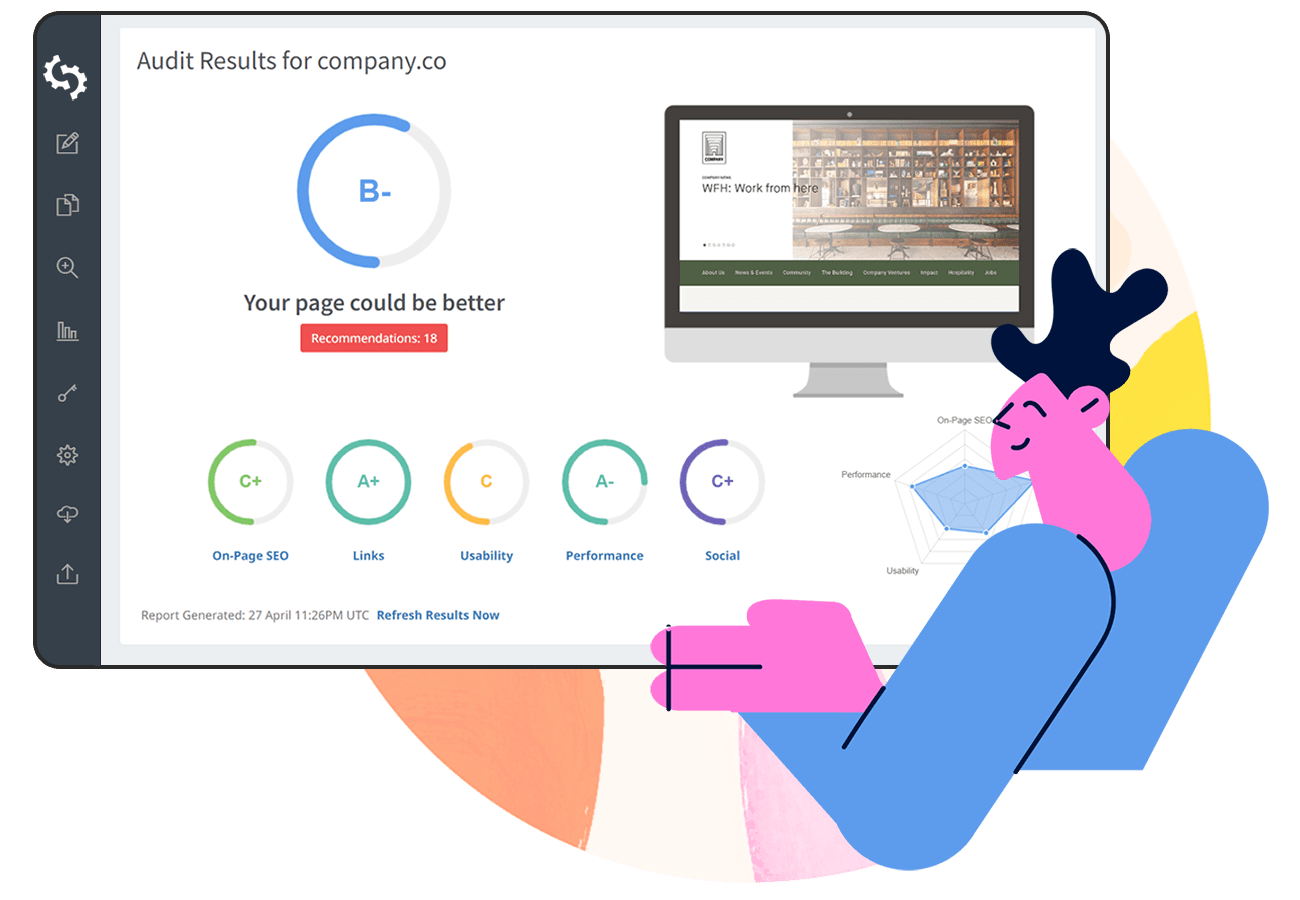

Le SEO Crawler de SEOptimer est un outil d'exploration de site web qui analyse les pages de votre site et identifie les [problèmes] liés au SEO sur plusieurs URL.

Il fonctionne en visitant des pages sur votre site Web et en collectant des données techniques et de SEO sur la page telles que les titres de pages, les méta-descriptions, les titres, les codes de statut, l'indexabilité, les redirections et les liens cassés.

Après l'exploration, l'outil génère un rapport d'exploration qui résume les "problèmes" trouvés sur votre site et les regroupe par "type" et "gravité".

Cela rend plus facile de repérer les "problèmes récurrents" et de [prioritiser] les correctifs, surtout sur les plus grands sites web où les vérifications manuelles des pages ne sont pas pratiques.

Le "SEO Crawler" est utile pour effectuer des audits SEO techniques, surveiller la santé du site au fil du temps et vérifier si les pages clés suivent les [meilleures] pratiques SEO.

Comment exécuter votre première "crawl"

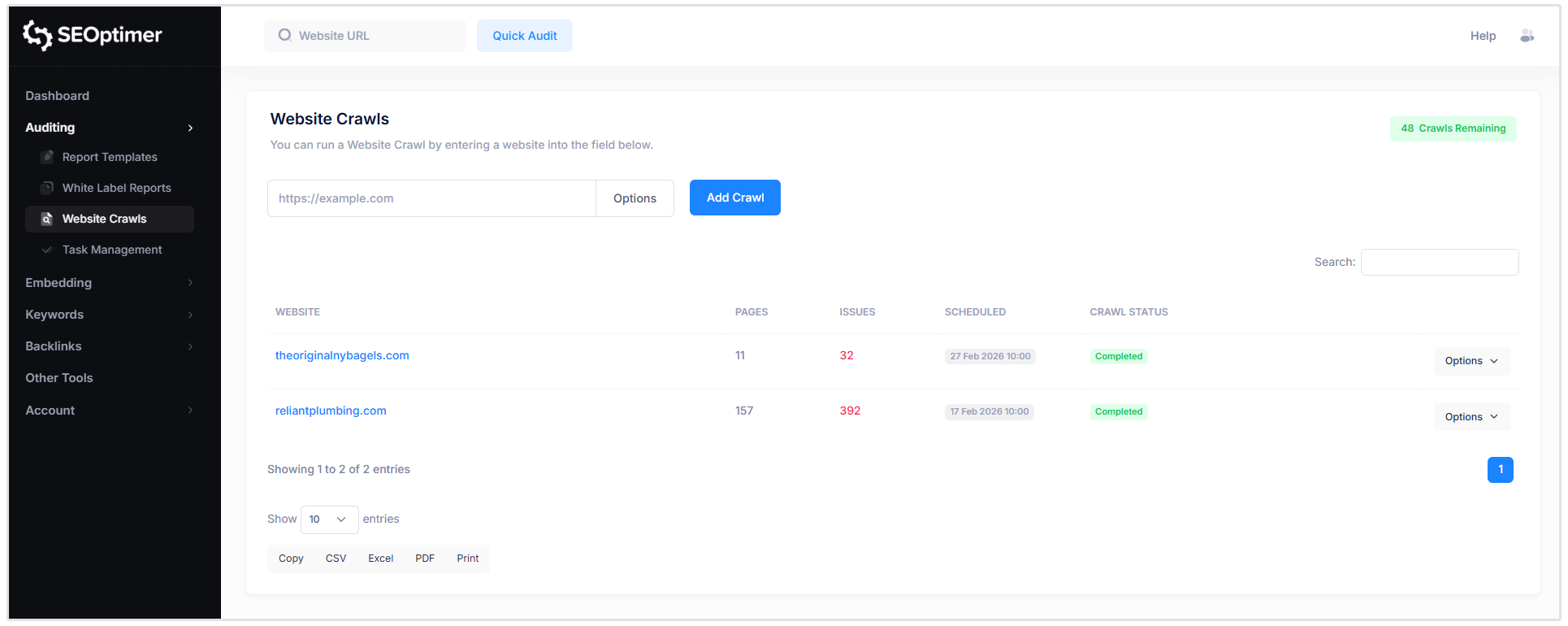

Pour lancer votre première exploration, cliquez sur l'option “Website Crawls” sous “Auditing” dans votre tableau de bord SEOptimer.

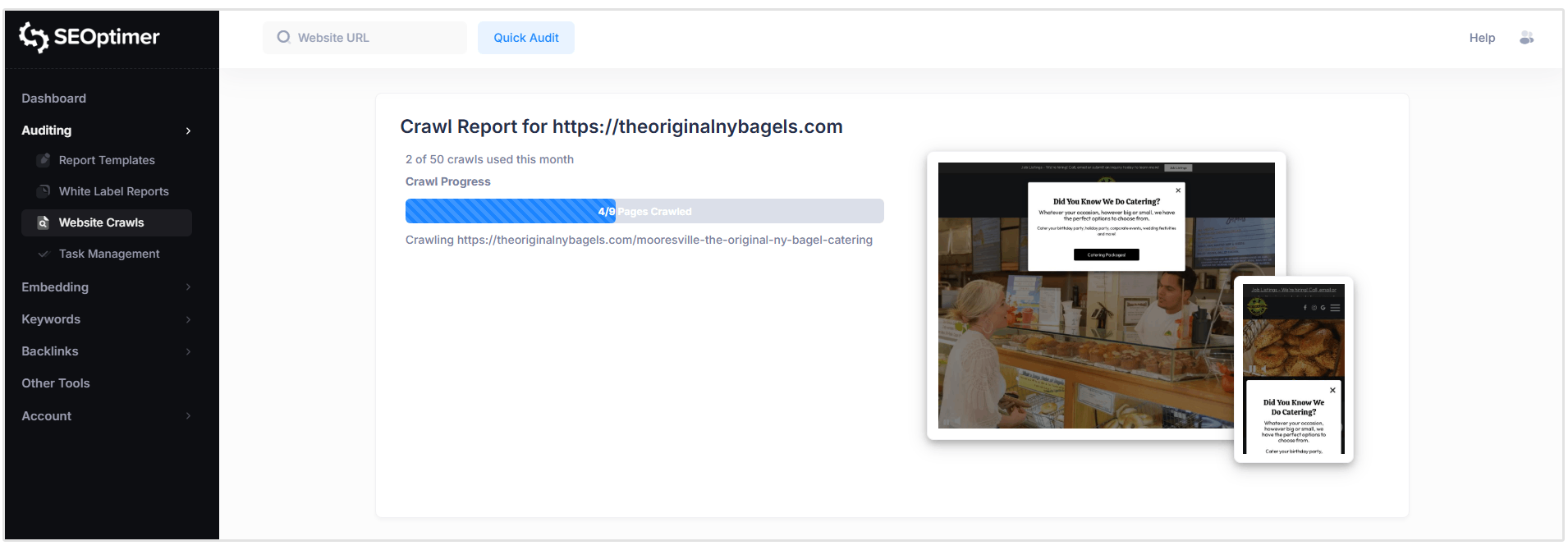

Ensuite, ajoutez l'URL de votre site web dans le champ ouvert et cliquez sur “Ajouter Crawl.”

C'est ça, vous avez lancé votre premier crawl de site SEOptimer !

Notre "SEO Crawler" va maintenant parcourir toutes les pages de votre site pour repérer tout problème qu'elles pourraient avoir.

Les "crawls" s'exécutent en temps réel, mais le temps total de [parcours] variera en fonction de la taille de votre site web et du nombre de pages qui doivent être scannées.

Alors que l'exploration est toujours en cours, vous pouvez commencer à examiner les "problèmes" dès qu'ils sont détectés en ouvrant le rapport d'exploration.

Que pouvez-vous "voir" dans chaque [rapport] d'exploration ?

Une fois que notre outil a terminé l'exploration de votre site, vous verrez trois sections principales :

- En-tête du rapport

- Pages identifiées

- Résumé du problème

Parcourons chacune de ces sections.

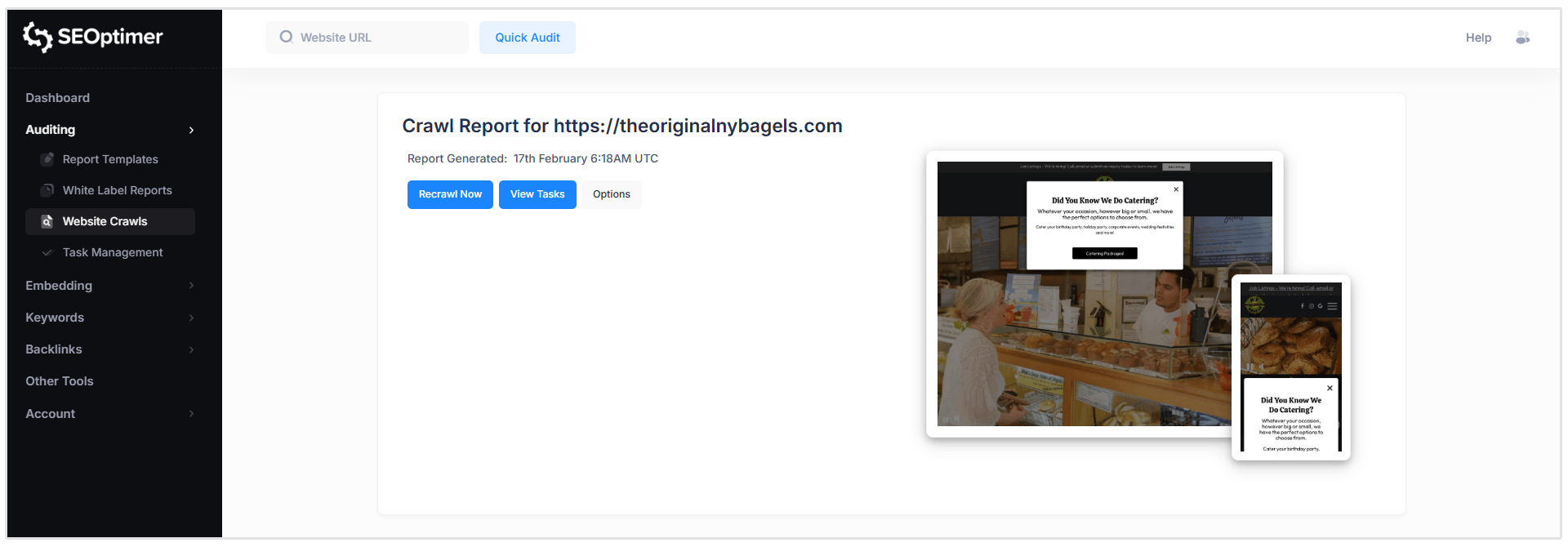

En-tête du rapport

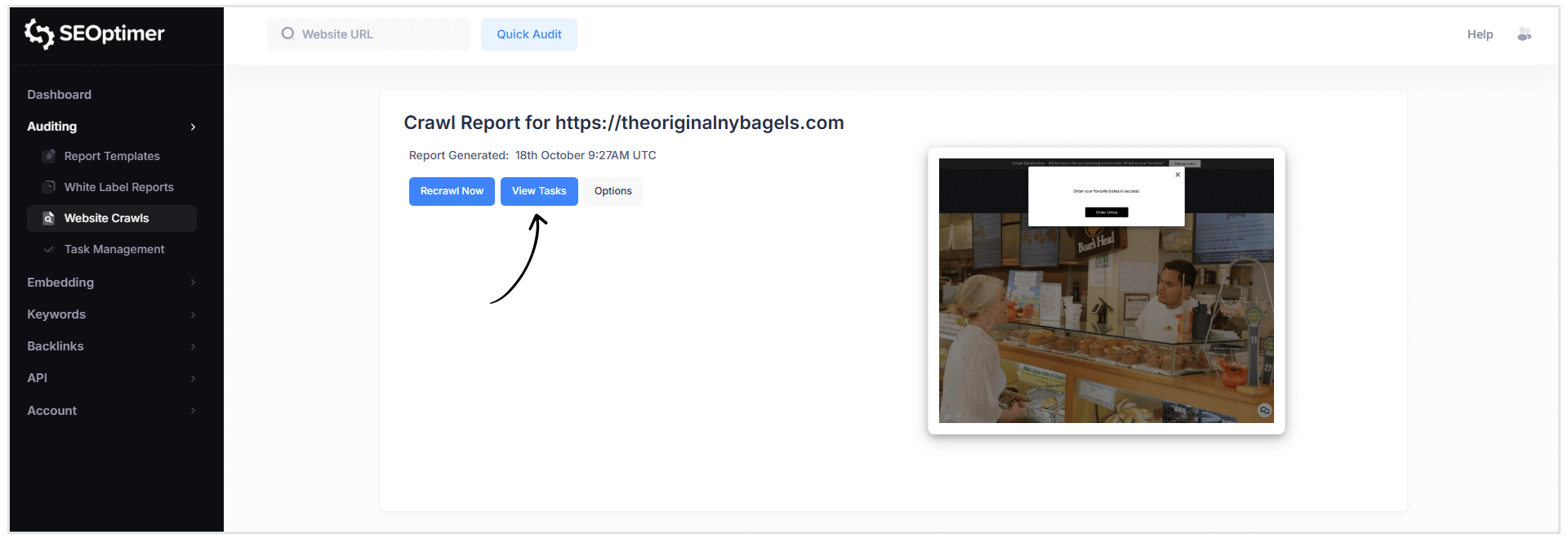

Voici où vous pouvez voir quand le rapport a été généré, demander un nouveau crawl, voir les tâches et personnaliser les règles de crawl. (plus d'informations sur ces fonctionnalités plus tard)

Pages Identifiées

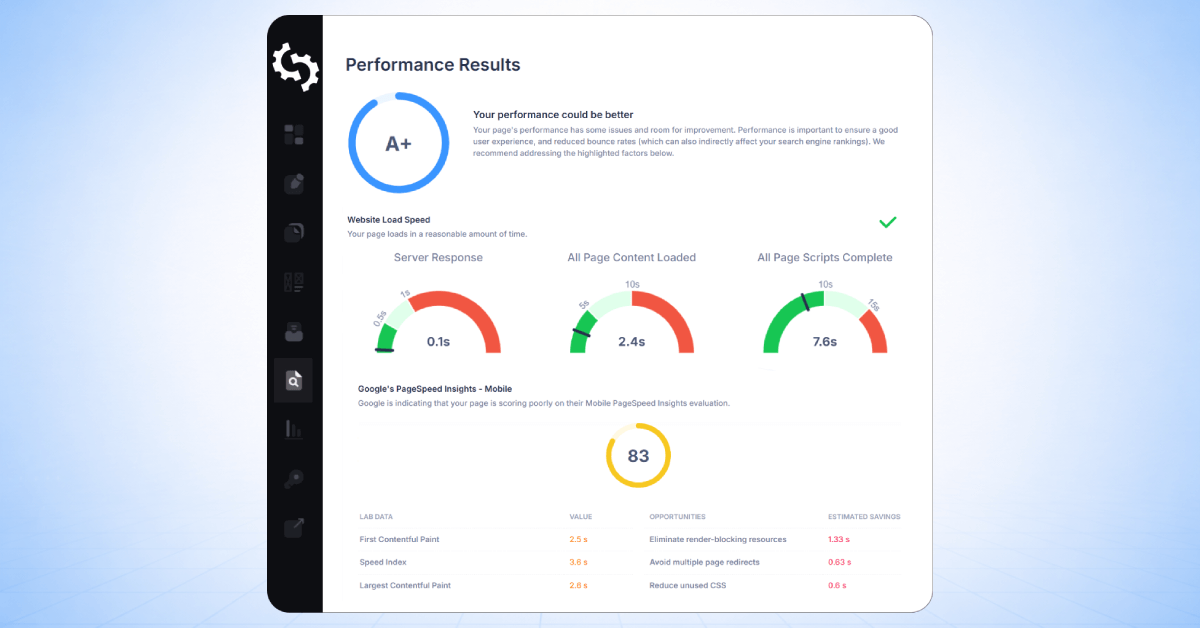

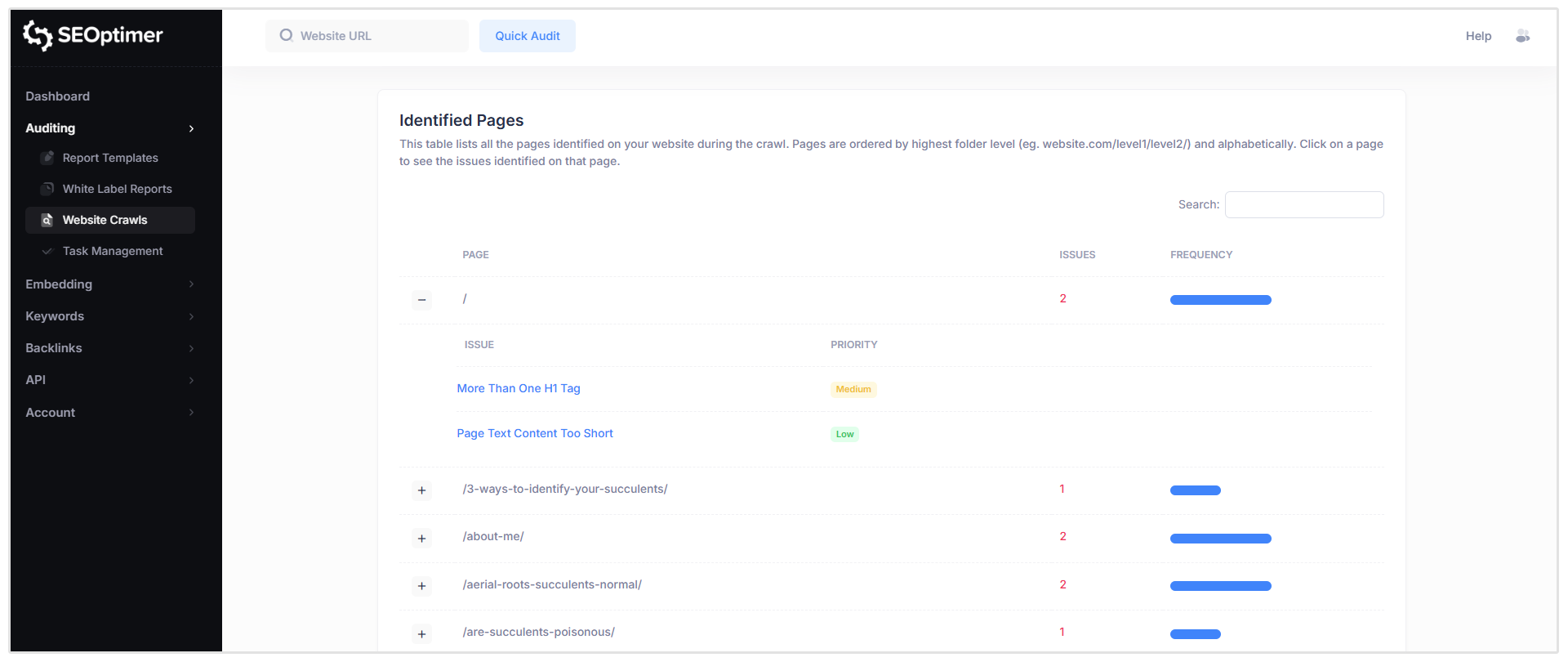

Cette section montre un tableau de toutes les pages découvertes lors de l'exploration, ainsi que les problèmes de SEO détectés pour chaque page.

Lorsque vous cliquez sur une page spécifique (par exemple, le chemin de la page d'accueil racine indiqué comme “/”), vous verrez une liste de tous les problèmes signalés pour cette URL, y compris le niveau de [gravité] de chaque problème.

Pour [voir] plus de [détails], cliquez sur n'importe quel problème dans la liste.

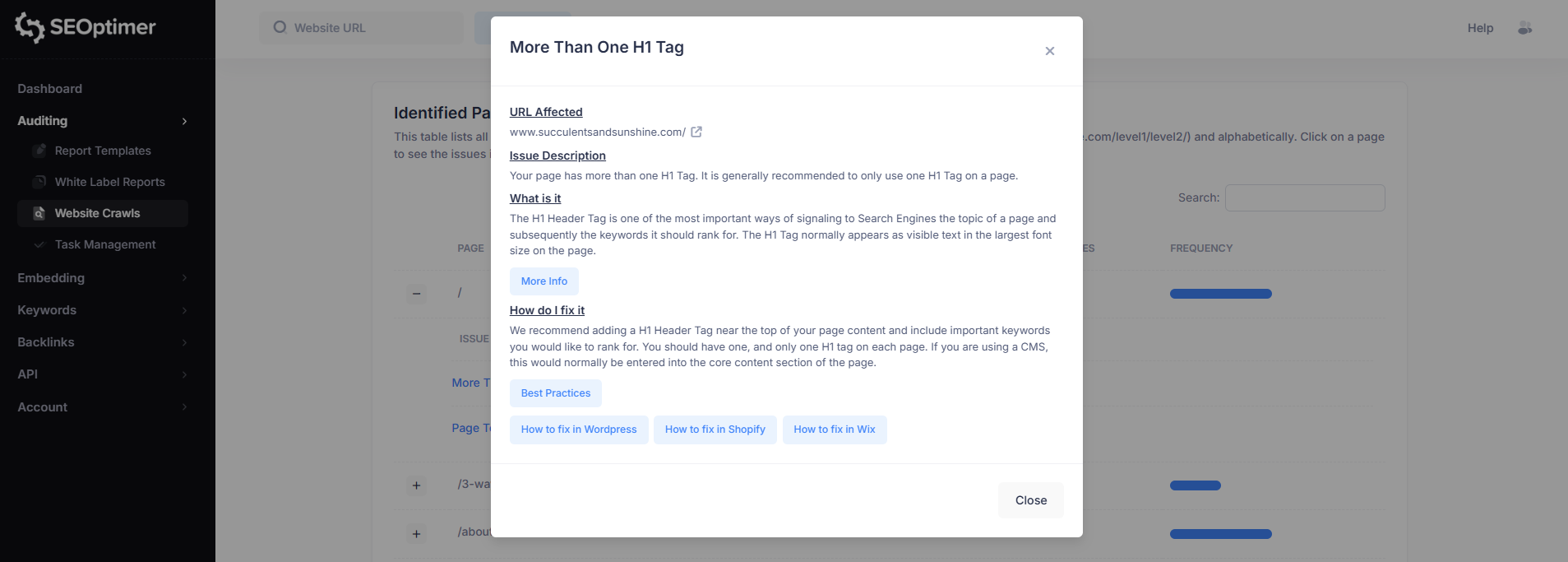

Par exemple, sélectionner “Plus d'un tag H1” ouvrira une analyse détaillée de ce problème pour la page sélectionnée.

Cette vue d'incident inclut :

- URL [affectée]

- Description du problème

- Ce que signifie le problème

- Comment le résoudre

Chaque fenêtre contextuelle de problème inclura également des liens vers des guides de soutien pour vous aider à résoudre le problème sur votre site web.

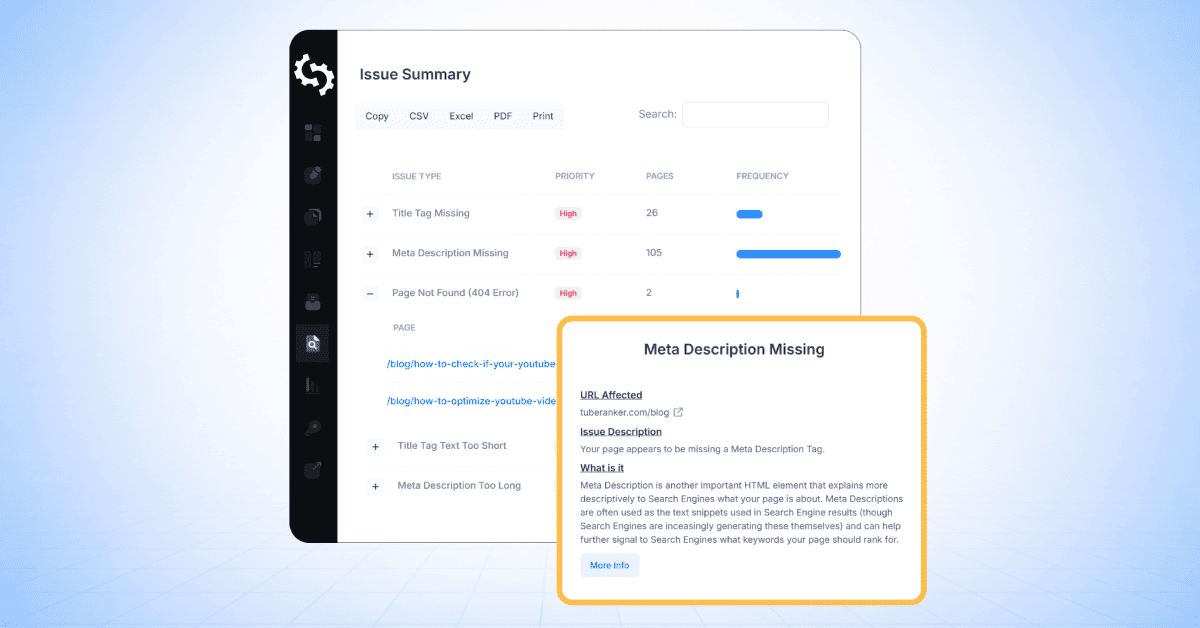

Résumé du problème

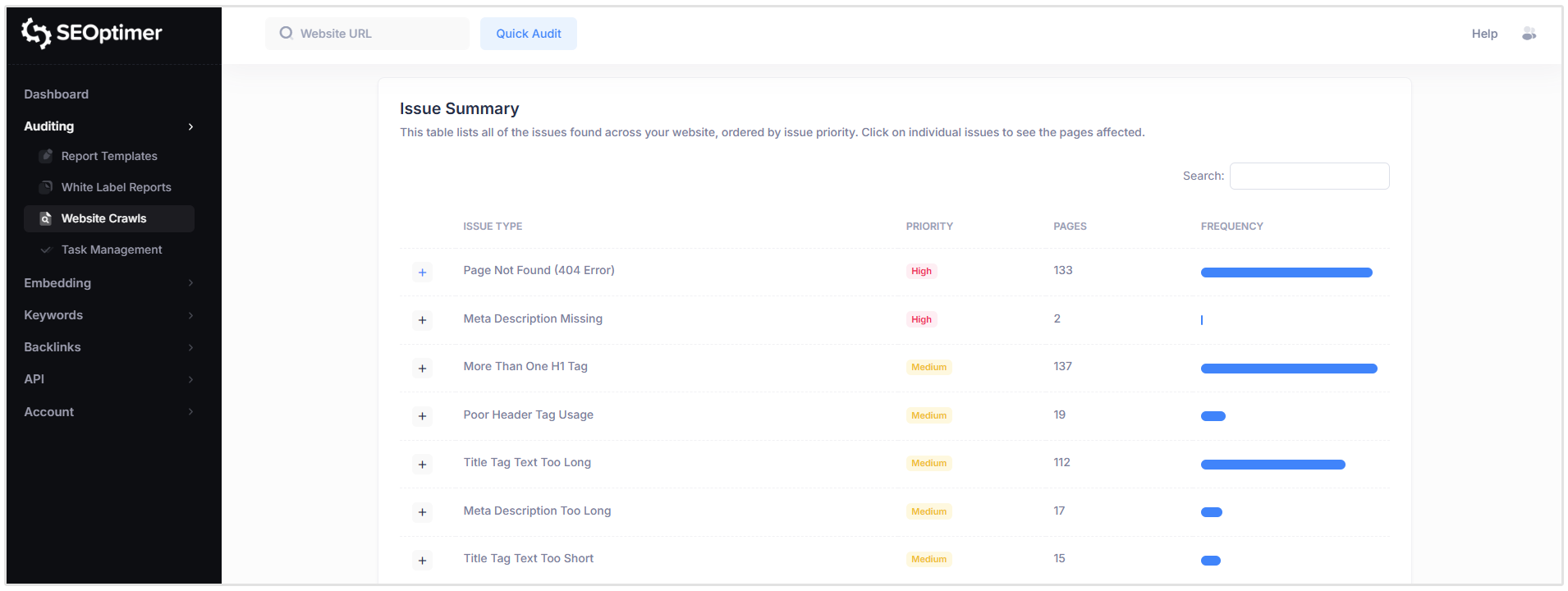

La section Résumé des problèmes fournit un aperçu de tous les problèmes de SEO détectés sur votre site web, regroupés par type de problème et classés par priorité.

Pour chaque "problème", le tableau montre :

- Type de problème

- Niveau de priorité

- Nombre de pages affectées

Donc, dans la capture d'écran ci-dessous d'un site que j'ai exploré, vous pouvez voir qu'il y a 137 pages qui ont plus d'une balise H1, 133 pages qui ont des erreurs 404, et 2 pages qui n'ont pas de "meta description".

Une fois que vous avez examiné le résumé du problème, vous pouvez passer à la configuration des paramètres de [crawl] et explorer d'autres options de SEO Crawler.

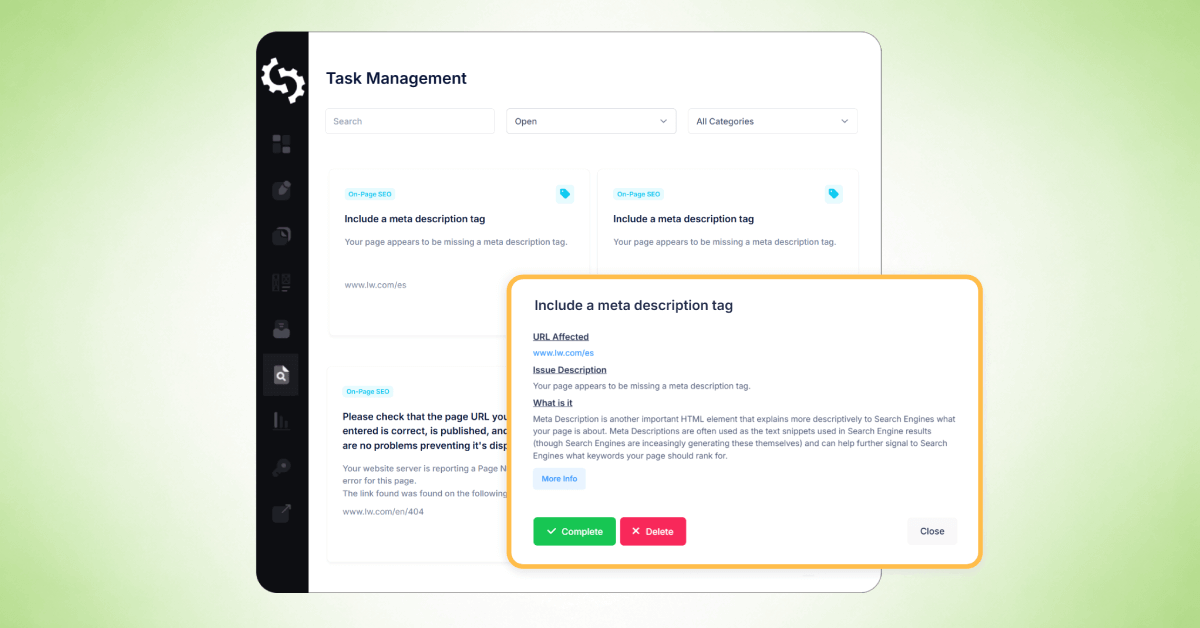

Voir les [tâches]

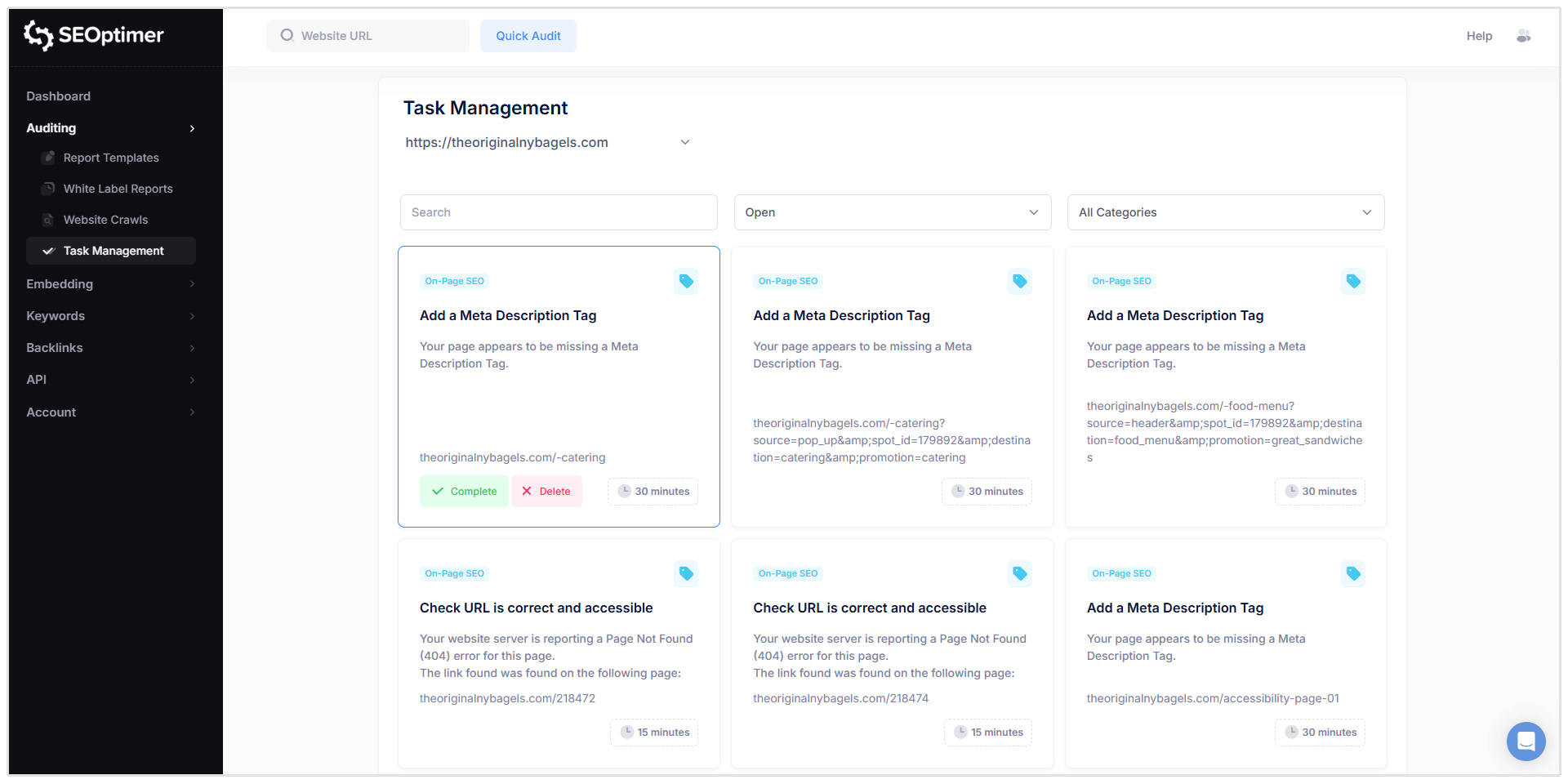

Après avoir terminé une exploration de site web, vous pouvez utiliser la fonctionnalité de gestion des tâches de SEOptimer pour organiser et suivre les [issues] identifiées dans votre rapport d'exploration.

L'outil de "Gestion des tâches" convertit les problèmes d'exploration en une liste de tâches que vous pouvez traiter dans un espace de travail unique, ce qui facilite la "priorisation" des corrections et le suivi des progrès au fil du temps.

Comment accéder à la "liste des tâches"

Vous pouvez ouvrir votre liste de tâches de deux manières :

- Cliquez sur le bouton bleu “Voir les tâches” dans l'en-tête du rapport d'exploration.

- Ou sélectionnez Gestion des tâches dans le menu de navigation à gauche de votre tableau de bord.

Remarque: Si vous avez exploré plusieurs sites web, vous pouvez basculer entre les listes de tâches à l'aide du menu déroulant en haut de la page de gestion des tâches.

Filtrage et gestion des tâches

Les "tâches" peuvent être filtrées par :

- Status (Ouvert, Terminé, Supprimé)

- Catégorie (par exemple, SEO sur la page, Liens, etc.)

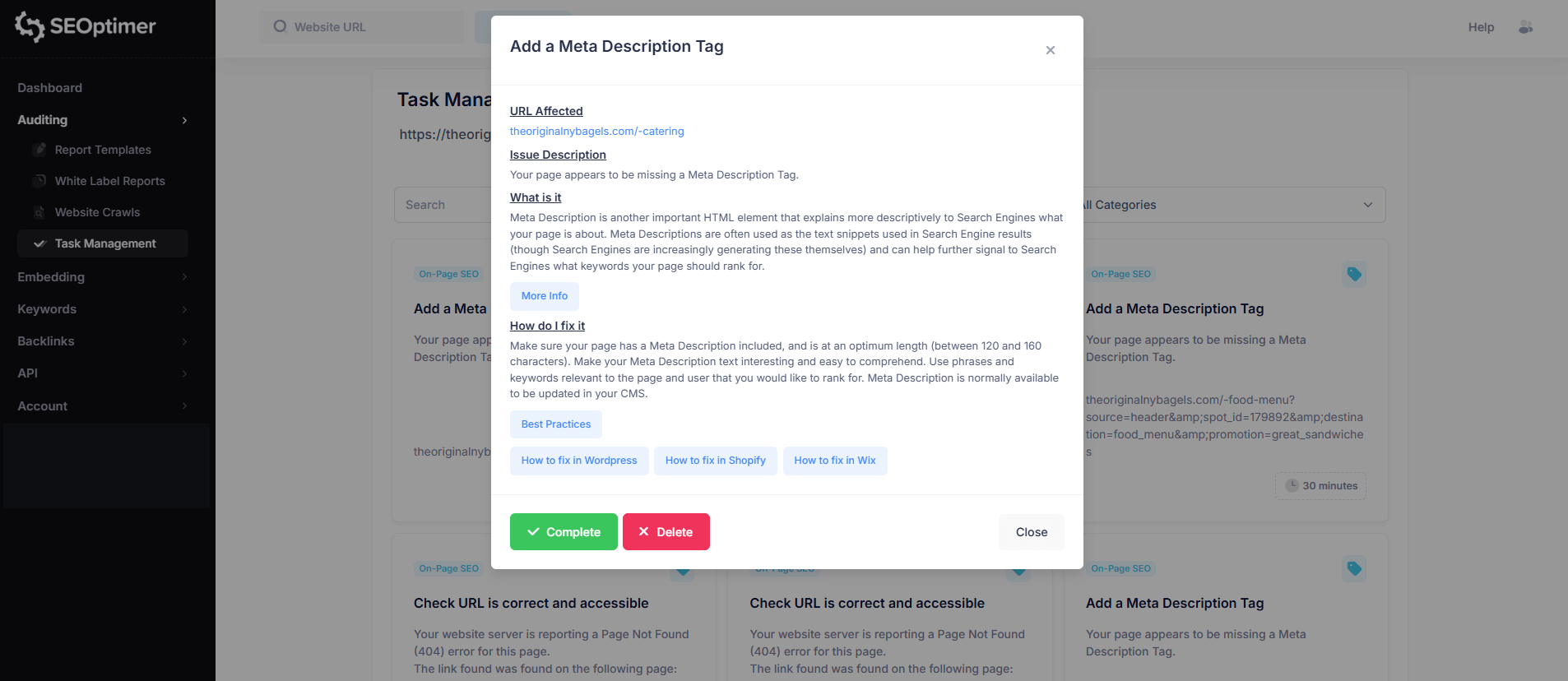

Lorsque vous cliquez sur une tâche, vous verrez des informations détaillées similaires au rapport de crawl, y compris :

- URL concernée

- Description du problème

- Ce que signifie le problème

- Comment le résoudre

- Options pour [terminer] la "tâche" ou la supprimer de la liste des "tâches"

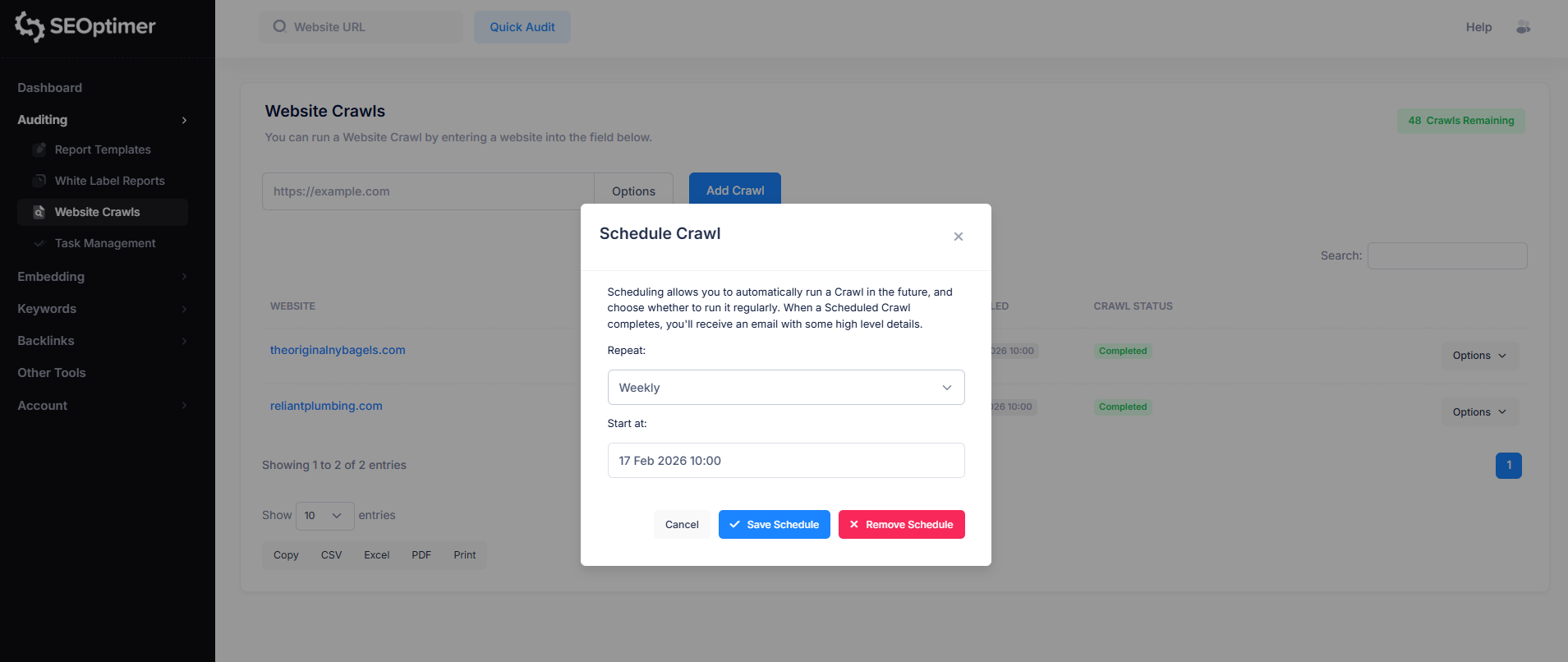

Comment Programmer des "Crawls"

Vous avez également la possibilité de programmer des analyses pour qu'elles s'exécutent sur une base hebdomadaire ou mensuelle. Cette fonctionnalité est particulièrement utile pour les agences gérant plusieurs sites web clients.

Pour [configurer] un calendrier de crawl, cliquez simplement sur le bouton “Options” à droite du site web pour lequel vous souhaitez [programmer] un crawl.

Ensuite, cliquez sur l'option “Planifier” et personnalisez le calendrier de crawl selon votre préférence.

Lorsque l'exploration programmée se termine, vous recevrez un e-mail avec quelques détails de haut niveau.

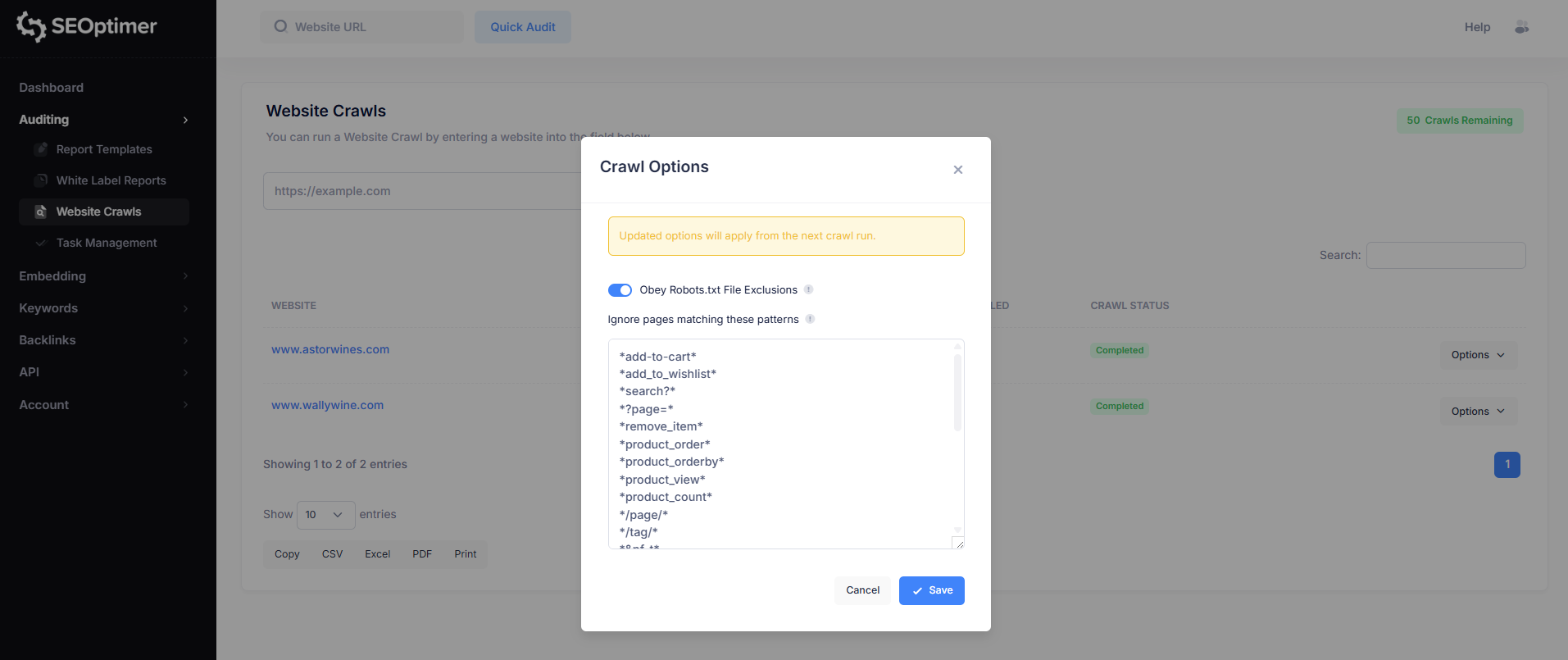

Définir vos propres "Crawl Rules"

Le "SEO Crawler" inclut des options de configuration d'exploration qui vous permettent de contrôler quelles pages sont incluses dans une exploration.

Ces paramètres sont utiles si vous souhaitez limiter les résultats, éviter les URLs en double, ou vous assurer que le robot d'exploration se comporte conformément aux règles d'indexation de votre site.

Respecter les exclusions de Robots.txt

Par défaut, le robot d'exploration peut suivre les règles définies dans le fichier robots.txt de votre site. Cela détermine si le robot d'exploration doit éviter de scanner les pages qui sont marquées comme interdites.

- Activé (recommandé) : Le robot d'exploration respectera les exclusions de robots.txt et ignorera les pages bloquées.

- Désactivé : Le robot d'exploration ignorera les règles de robots.txt et tentera d'explorer toutes les pages auxquelles il peut accéder.

Dans la plupart des cas, il est recommandé de respecter robots.txt, surtout lors de l'exécution de "crawls" sur des sites de production en direct.

Ignorer les pages correspondant à ces motifs

Certaines sites web génèrent plusieurs versions de la même page en utilisant des paramètres d'URL (par exemple, "tri", "filtrage", "pagination" ou codes de suivi).

Ceci est particulièrement courant sur les sites web de commerce électronique.

L'option “Ignorer les pages correspondant à ces modèles” vous permet d'exclure ces URLs en double ou de faible valeur de l'exploration. Cela aide à maintenir des résultats d'exploration plus propres et facilite la révision des rapports de problèmes.

C'est une fonctionnalité plus avancée et est principalement utile pour les sites web avec un grand nombre d'URLs basées sur des paramètres.

SEOptimer inclut un ensemble par défaut de modèles d'exclusion pour filtrer les doublons courants basés sur des paramètres, mais vous pouvez ajouter vos propres règles si nécessaire.

Ces motifs suivent la syntaxe standard de correspondance robots.txt.

Si vous n'êtes pas familier avec les règles "robots.txt" ou la correspondance de motifs d'URL, il est recommandé de revoir les bases avant d'ajouter des exclusions de crawl personnalisées. Des motifs incorrects peuvent empêcher des pages importantes d'être explorées.

Voici quelques références utiles :

- Robots.txt - Le Guide Ultime

- Introduction et guide de Robots.txt | Google Search Central

- Comment Google interprète la spécification robots.txt

- Syntaxe de Robots.txt

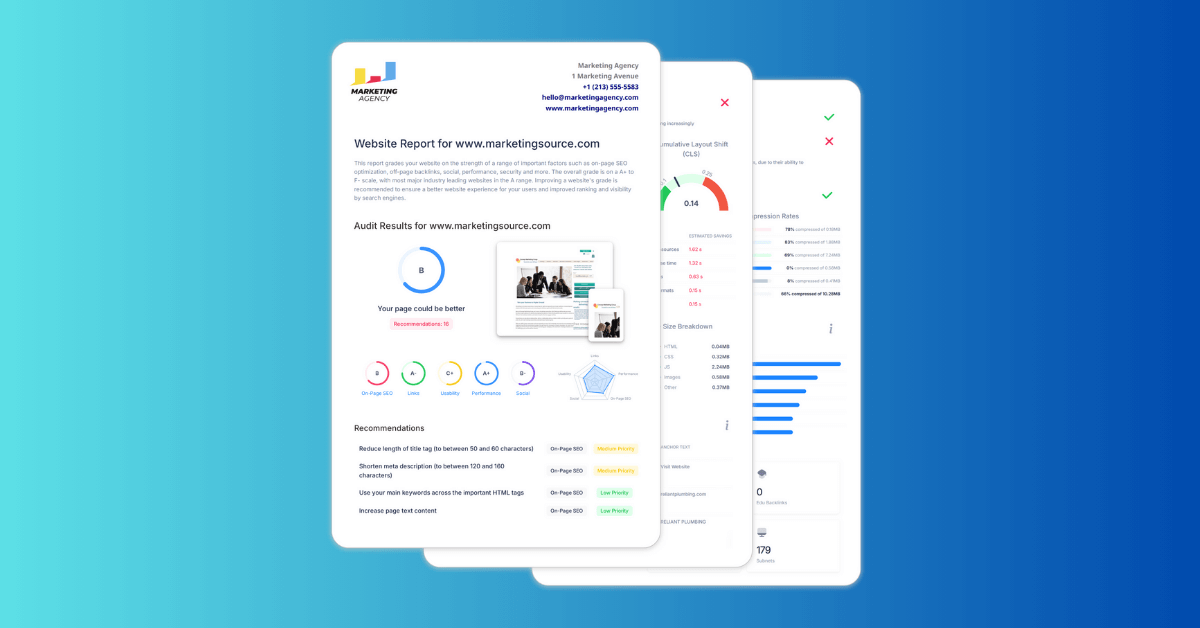

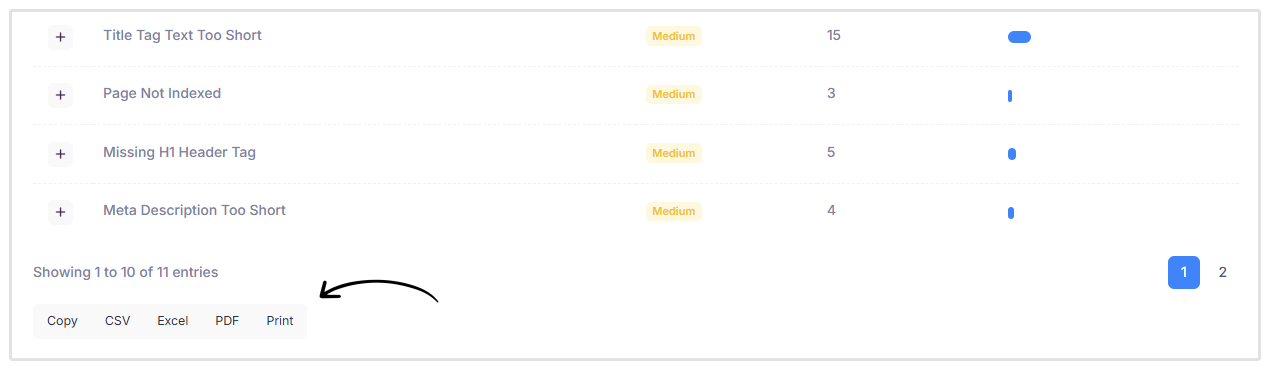

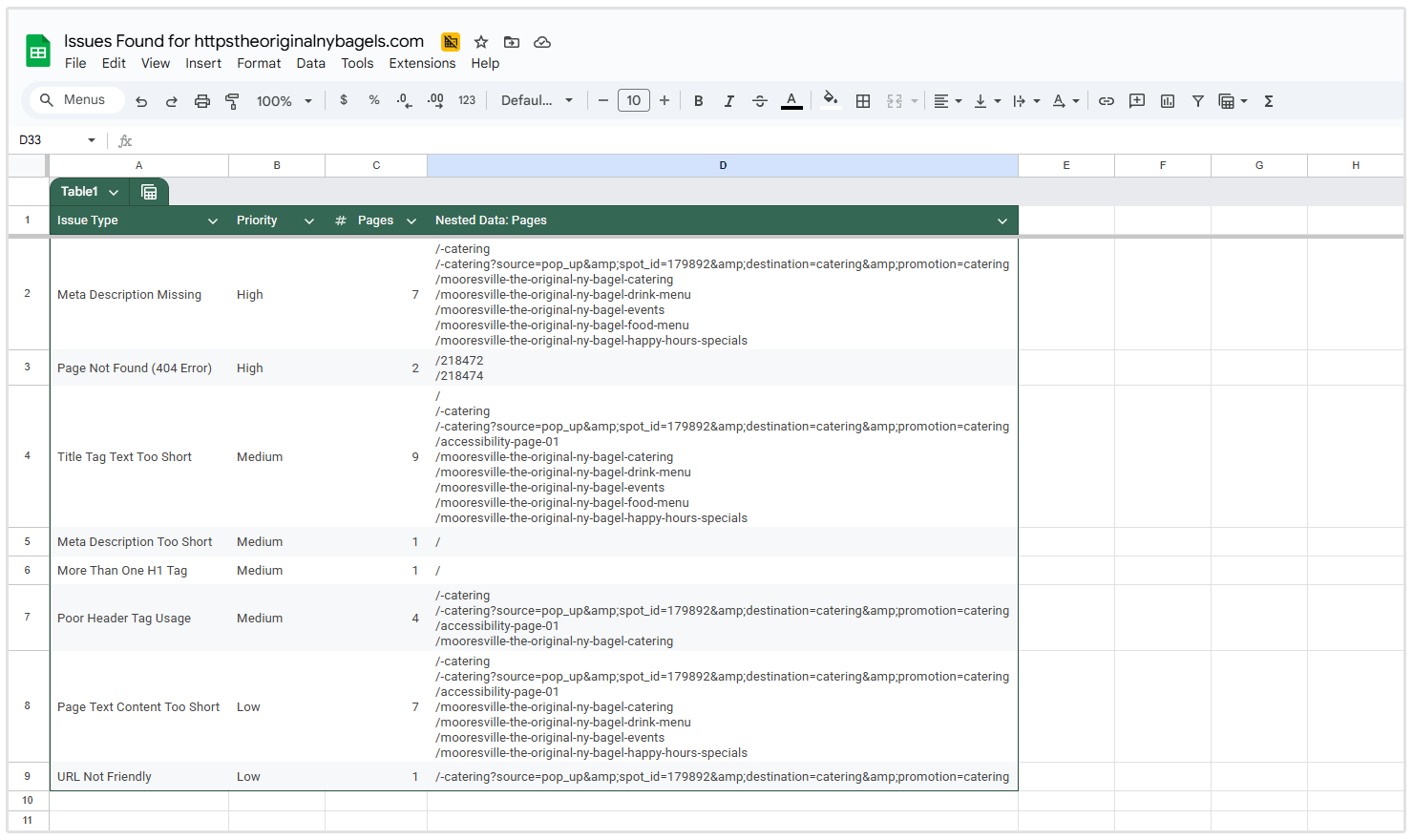

Comment exporter des "données" de [crawl]

Chaque tableau dans le rapport SEO Crawler comprend des options d'exportation intégrées, vous permettant de télécharger ou de partager les résultats de "crawl" en dehors de la plateforme.

Au bas de chaque tableau, vous verrez des boutons d'exportation qui vous permettent de "sortir" les données dans différents formats :

- CSV : Télécharger le tableau en tant que fichier .csv (utile pour les "tableurs" et le traitement des données).

- Excel : Exporter le tableau en tant que fichier Excel pour le "reporting" ou une analyse plus approfondie.

- PDF : Générer une version PDF du tableau pour le partage ou la documentation.

- Print : Ouvrir une version imprimable du tableau.

Les "exports" s'appliquent au tableau spécifique que vous visualisez, ce qui facilite le téléchargement des listes de [problèmes], des rapports de page ou des résultats filtrés selon les besoins.

Conclusion

Le SEO Crawler de SEOptimer facilite l'identification des problèmes techniques et de SEO "on-page" sur l'ensemble de votre site web en un seul crawl.

En examinant le rapport d'exploration et en utilisant la liste de tâches intégrée, vous pouvez rapidement transformer les résultats de l'exploration en améliorations "actionnables".

Pour obtenir les meilleurs résultats, envisagez de programmer des analyses régulières pour surveiller les changements au fil du temps et détecter de nouveaux problèmes à mesure que votre site Web se développe.

Besoin d'aide ?

Chat en direct : Cliquez sur Chat en direct (en bas à droite)

Email : [email protected]

Temps de réponse : Dans les 24 heures