SEOptimer’s SEO Crawler hjælper dig med at scanne og revidere siderne på din hjemmeside for at identificere tekniske SEO-problemer i stor skala.

I stedet for at tjekke sider én efter én, gennemgår crawleren din webstedsstruktur, analyserer SEO-elementer på tværs af flere URL'er og fremhæver problemer, der kan påvirke indeksering, brugervenlighed eller søgesynlighed.

I denne guide vil du:

- "Kør din første gennemgang"

- "Gennemgå rapporten for gennemgangen"

- "Lær hvordan man opsætter tilpassede regler for gennemgang"

- "Planlæg og eksportér websteds-gennemgange"

Hvad er SEOptimer’s SEO Crawler?

SEOptimer’s SEO Crawler er et værktøj til webcrawl, der scanner dine siders sider og identificerer SEO-relaterede [problemer] på tværs af flere URL'er.

Det fungerer ved at besøge sider på din hjemmeside og indsamle tekniske og on-page SEO-data såsom [sidetitler], [metabeskrivelser], [overskrifter], [statuskoder], [indekserbarhed], [omdirigeringer] og [brudte links].

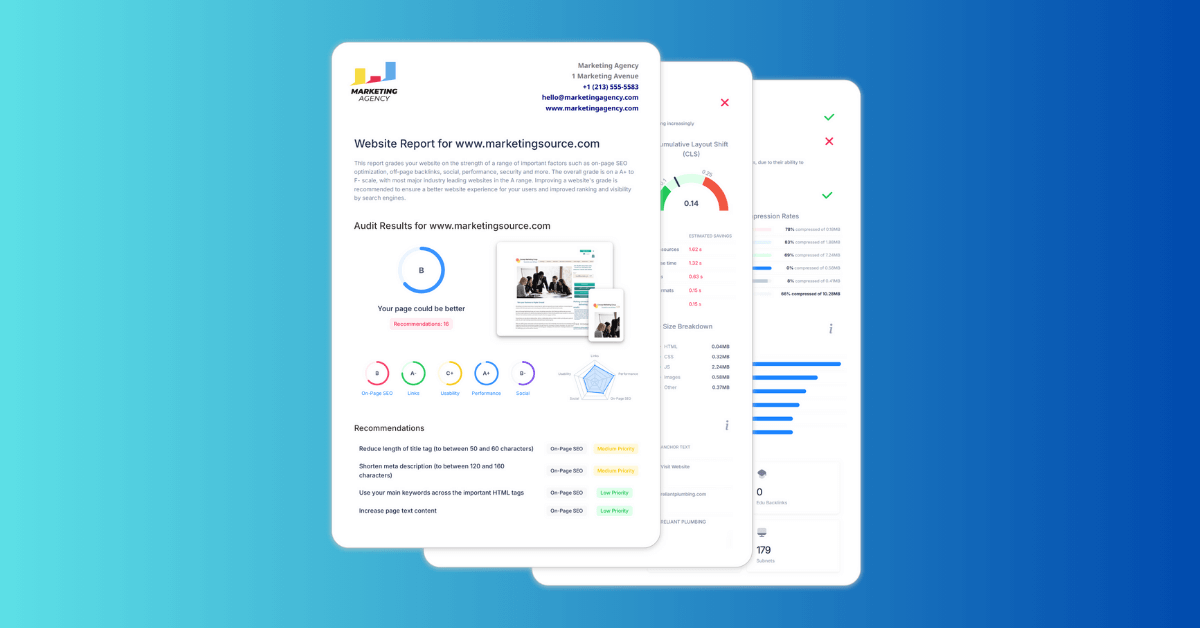

Efter gennemgangen er færdig, genererer værktøjet en gennemgangsrapport, der opsummerer problemer fundet på dit websted og grupperer dem efter type og alvorlighed.

Dette gør det lettere at få øje på tilbagevendende problemer og prioritere [rettelser], især på større websites hvor manuelle [kontroller] af sider ikke er praktiske.

Den "SEO Crawler" er nyttig til at udføre tekniske "SEO audits", overvåge webstedets sundhed over tid og kontrollere, om nøglesider følger "SEO best practices".

Sådan kører du din første [Crawl]

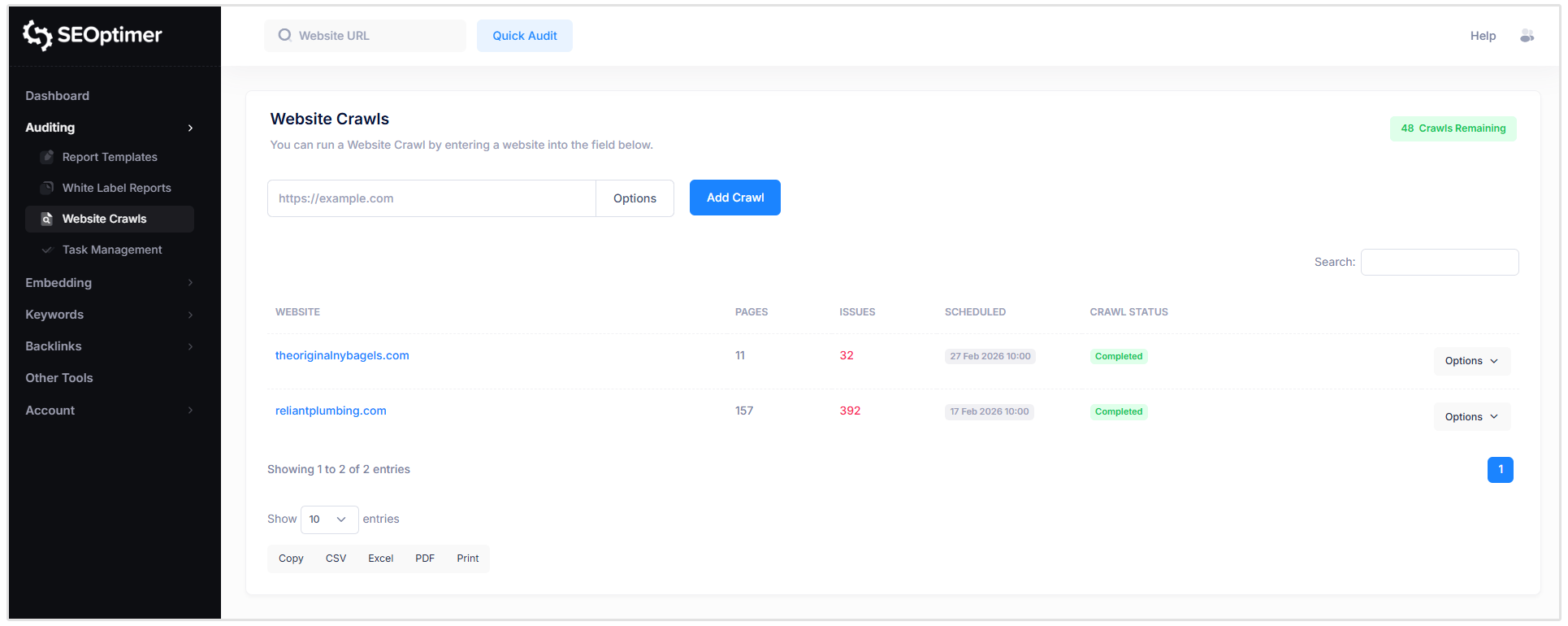

For at køre din første crawl, klik på “Website Crawls”-muligheden under “Auditing” i din SEOptimer-dashboard.

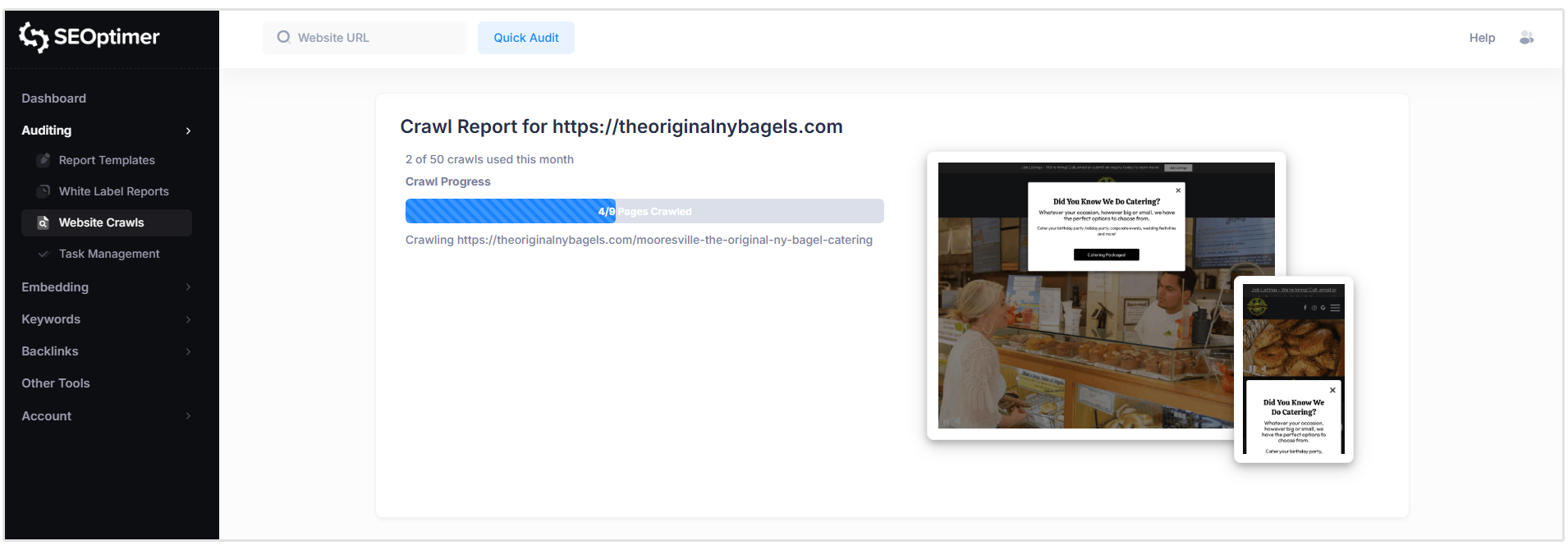

Derefter skal du tilføje din hjemmesides URL til det åbne felt og klikke på “Tilføj Crawl.”

Det er det, du er startet på din første SEOptimer sidegennemgang!

Vores SEO Crawler vil nu gennemgå alle siderne på dit websted for at "opdage" eventuelle [problemer], de måtte have.

Crawls kører i realtid, men den samlede crawl-tid vil variere afhængigt af størrelsen på din hjemmeside og antallet af sider, der skal scannes.

Mens gennemgangen stadig kører, kan du begynde at gennemgå "problemer", efterhånden som de opdages, ved at åbne "gennemgangsrapporten".

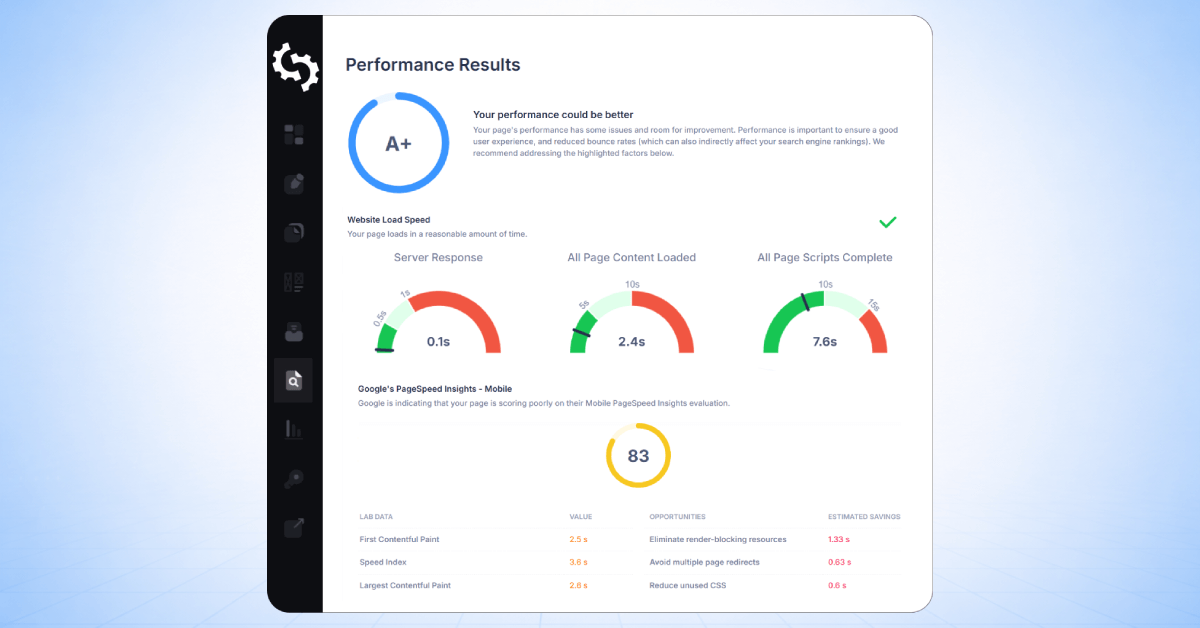

Hvad kan du "se" i hver "crawl-rapport"?

Når vores værktøj er færdig med at gennemgå din side, vil du se tre hovedsektioner:

- Rapportoverskrift

- Identificerede sider

- "Problemer" [resumé]

Lad os gennemgå hver af disse sektioner.

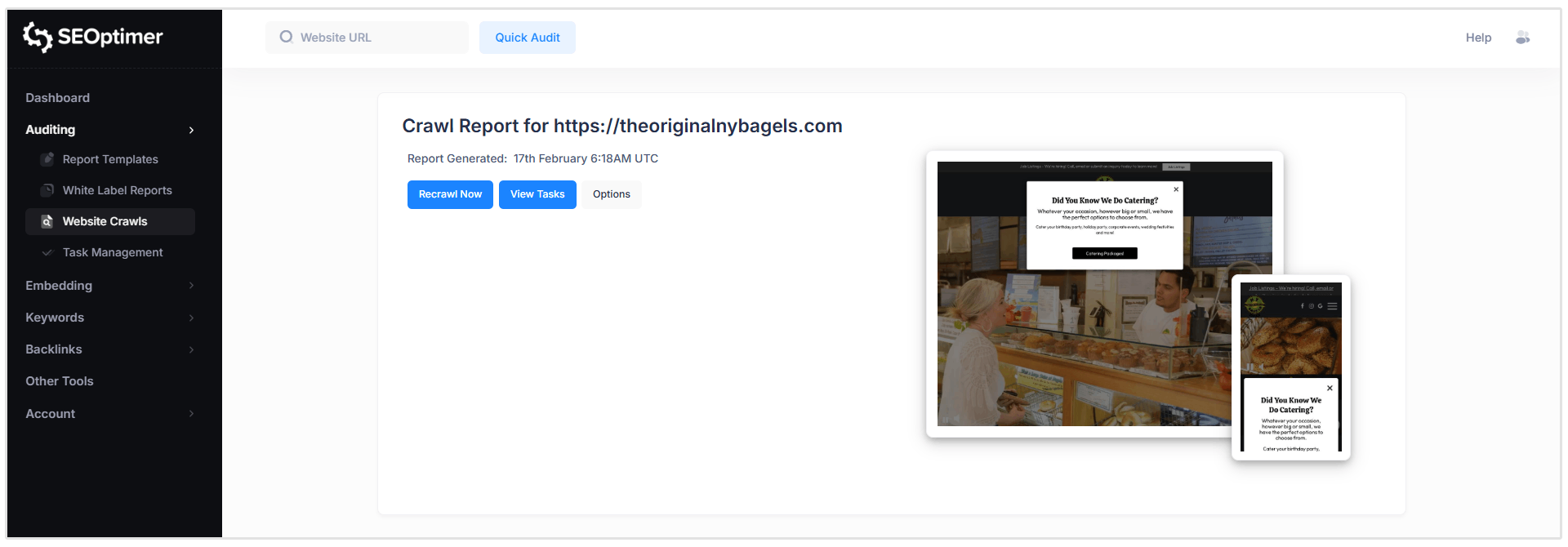

Rapportoverskrift

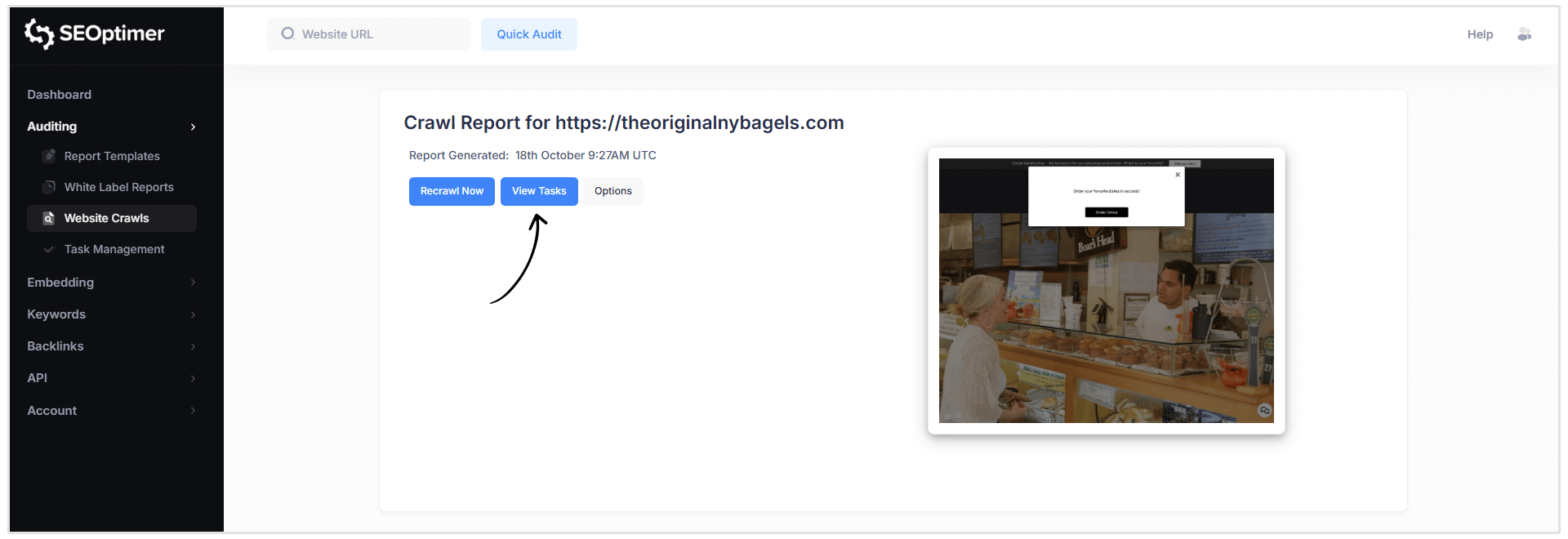

Her kan du se, hvornår rapporten blev genereret, bede om en genindeksering, se opgaver og tilpasse crawl-regler. ("mere om disse funktioner senere")

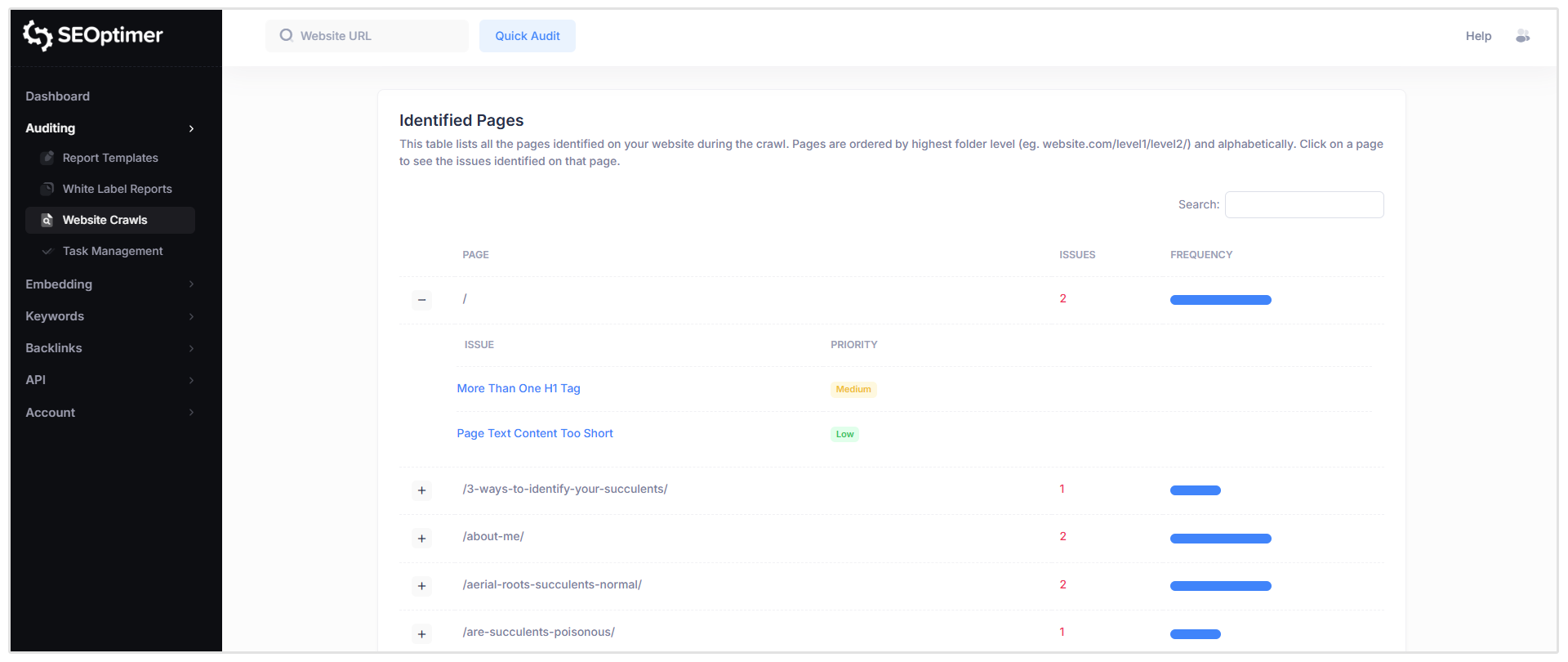

Identificerede sider

Denne sektion viser en tabel over alle sider opdaget under gennemgangen, sammen med de SEO-problemer der blev registreret for hver side.

Når du klikker på en specifik side (for eksempel, rodstartsidebanen vist som “/”), vil du se en liste over alle "problemer" [markeret] for den URL, inklusive "alvorlighedsniveauet" [af] hvert "problem".

For at se flere detaljer, klik på et hvilket som helst problem i listen.

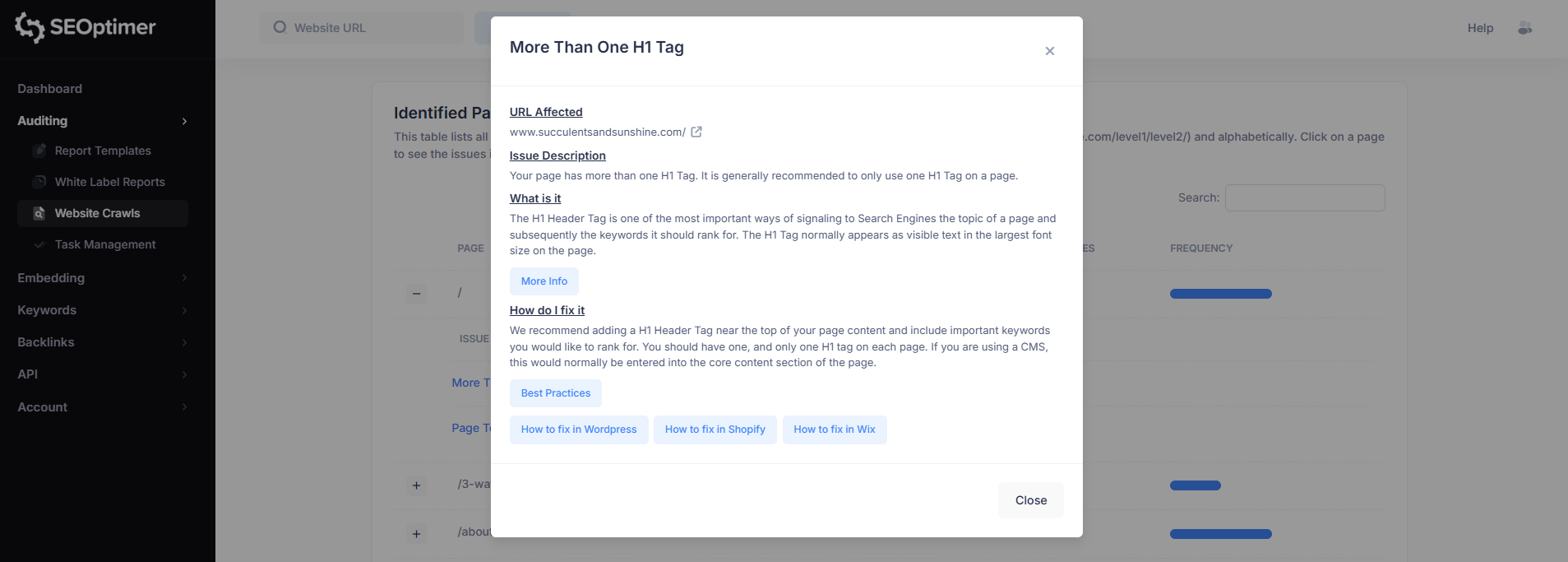

For eksempel vil valget “Mere end én H1-tag” åbne en detaljeret oversigt over det problem for den valgte side.

Dette "issue view" [inkluderer]:

- Påvirket URL

- Problembeskrivelse

- Hvad problemet betyder

- Hvordan man løser det

Hver "problem"-pop-up vil også inkludere links til [understøttende] guider for at hjælpe dig med at løse "problemet" på din [hjemmeside].

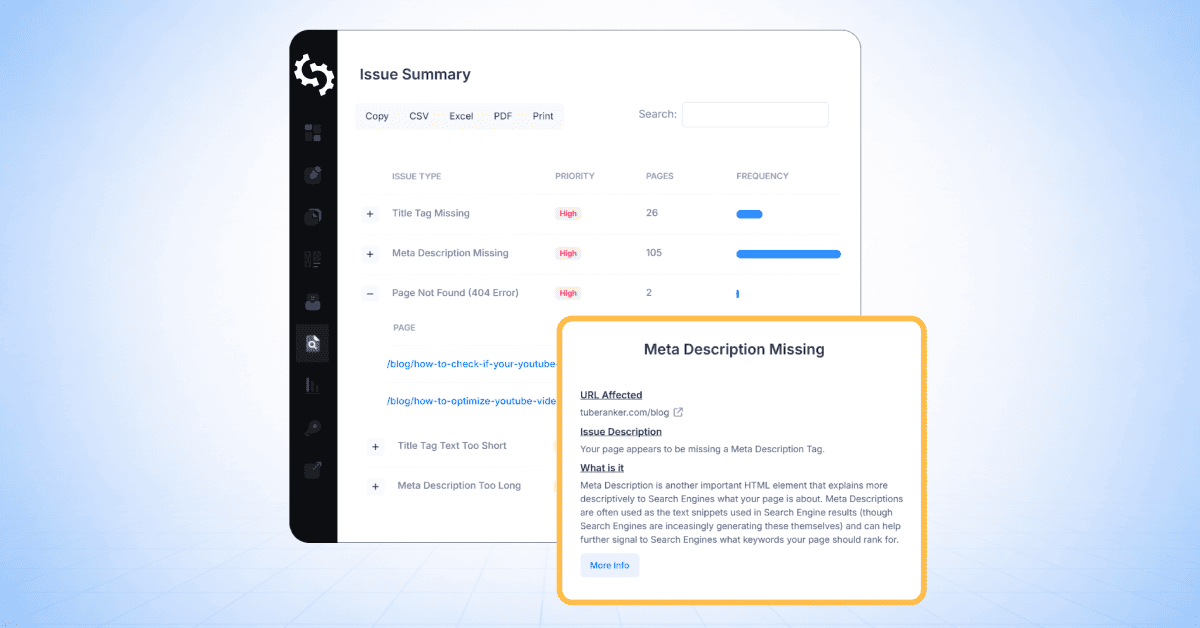

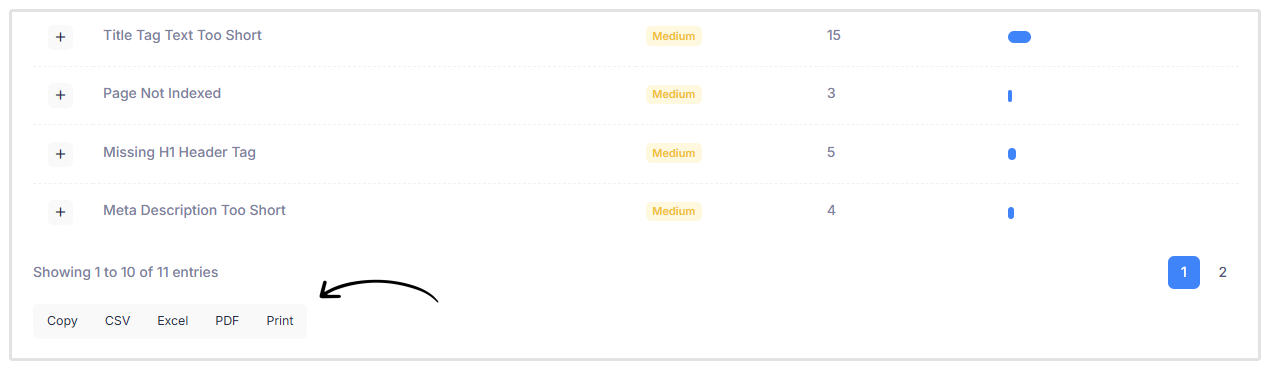

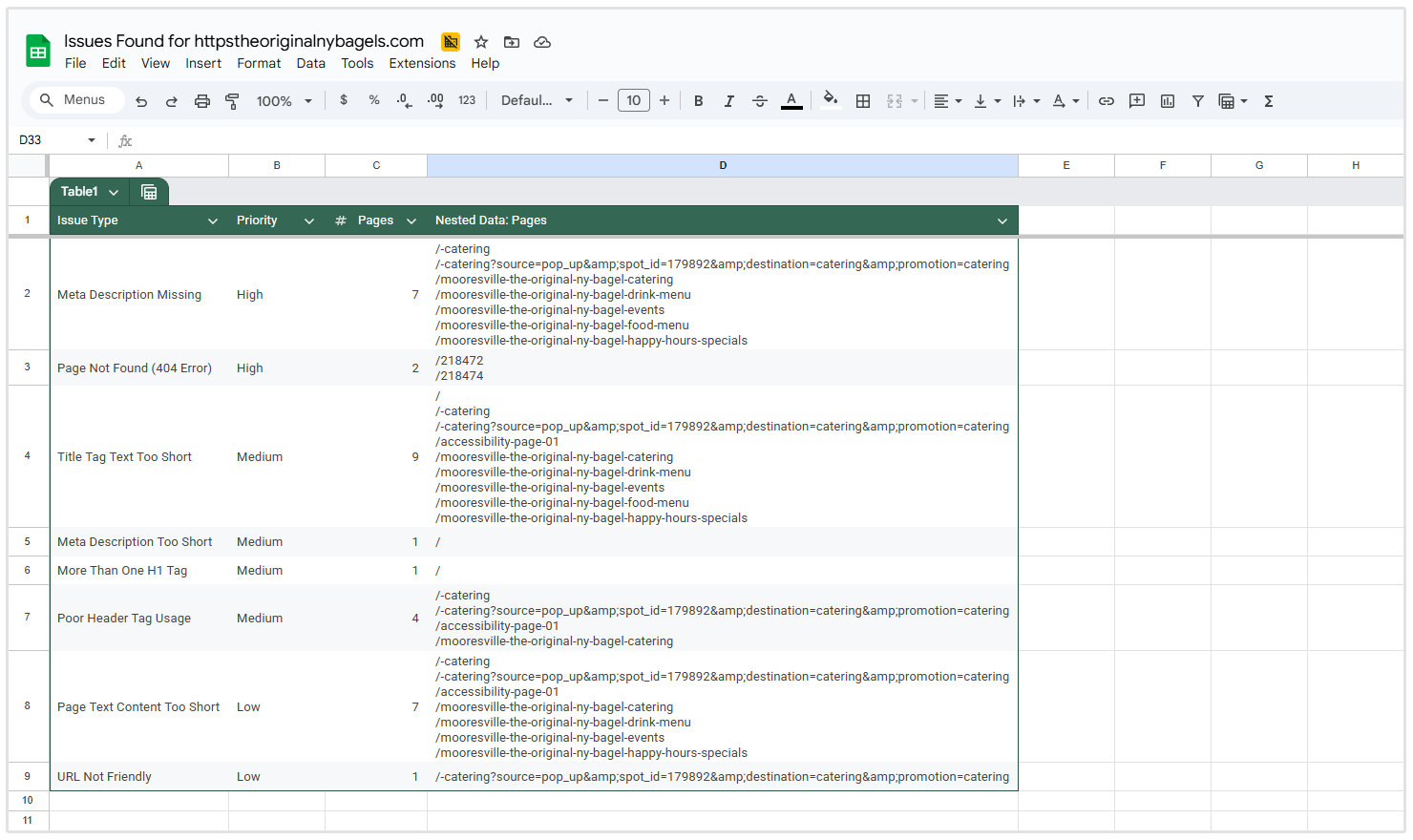

Problemoversigt

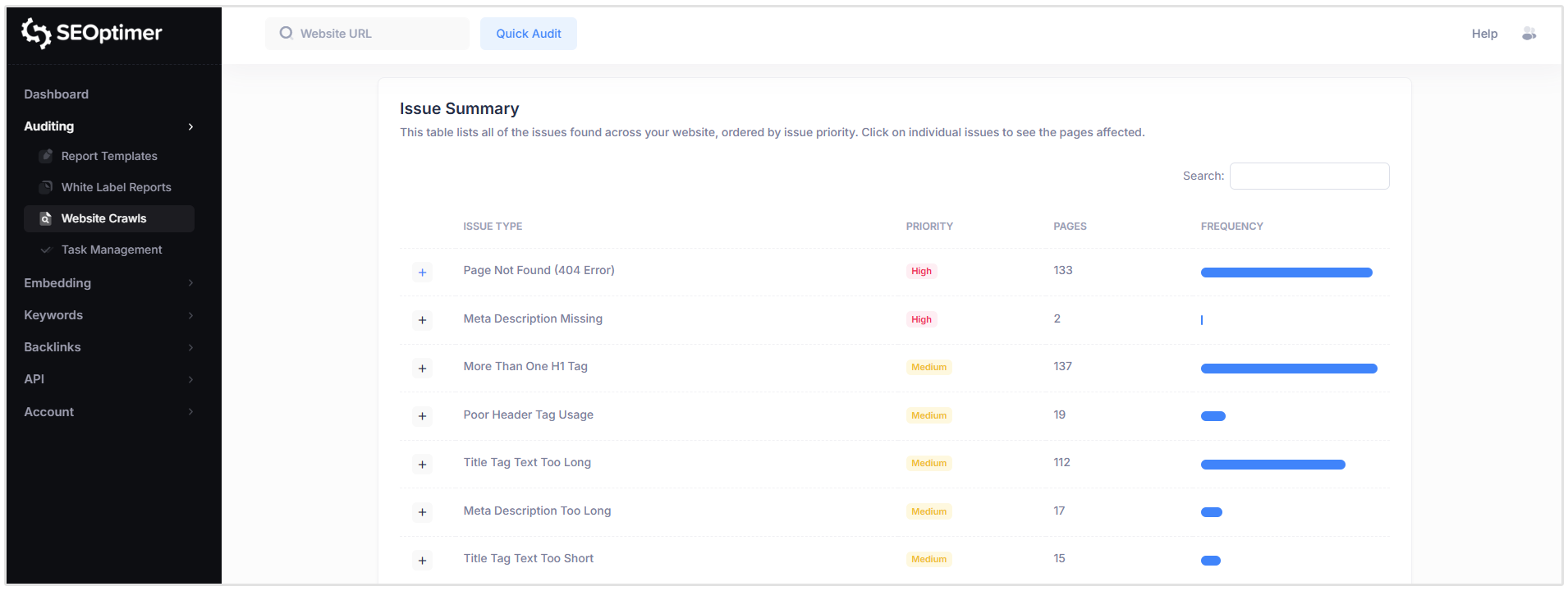

"Afsnittet [Sammendrag af problem] giver et overblik over alle SEO-problemer, der er opdaget på tværs af dit website, grupperet efter [problemtype] og ordnet efter [prioritet].

For hvert "problem", viser tabellen:

- "Problemtype"

- "Prioritetsniveau"

- "Antal berørte sider"

Så i nedenstående skærmbillede af et site, jeg har crawlet, kan du se, at der er 137 sider, der har mere end én H1-tag, 133 sider, der har 404-fejl, og 2 sider, der ikke har en meta beskrivelse.

Når du har gennemgået "issue summary", kan du fortsætte med at konfigurere "crawl settings" og udforske yderligere SEO Crawler muligheder.

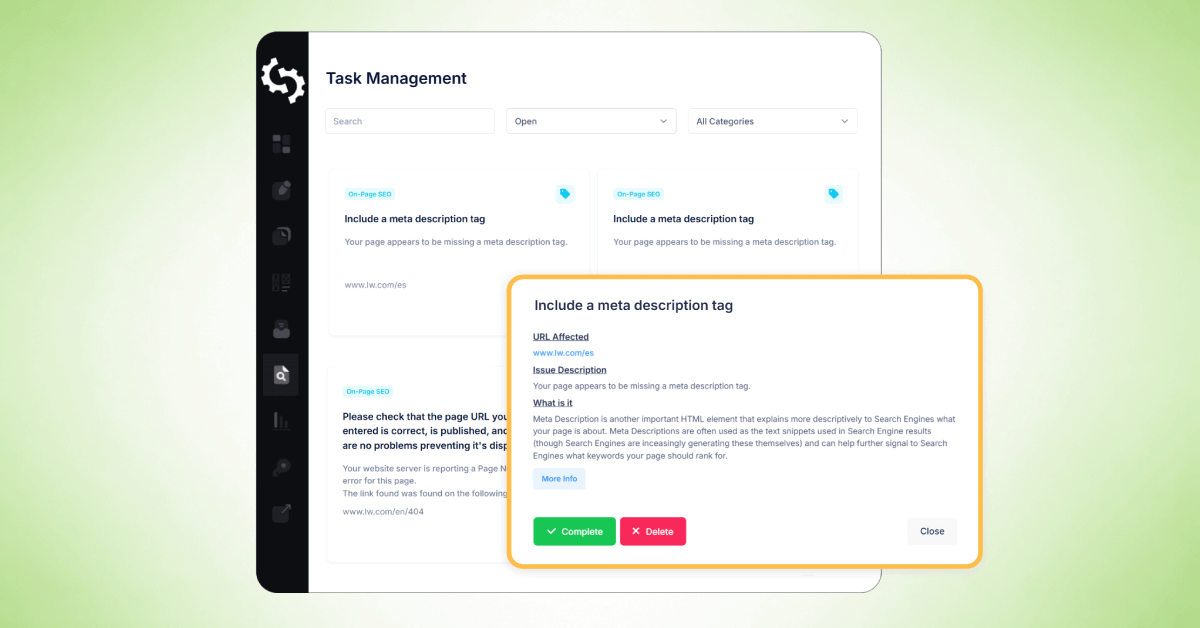

Se Opgaver

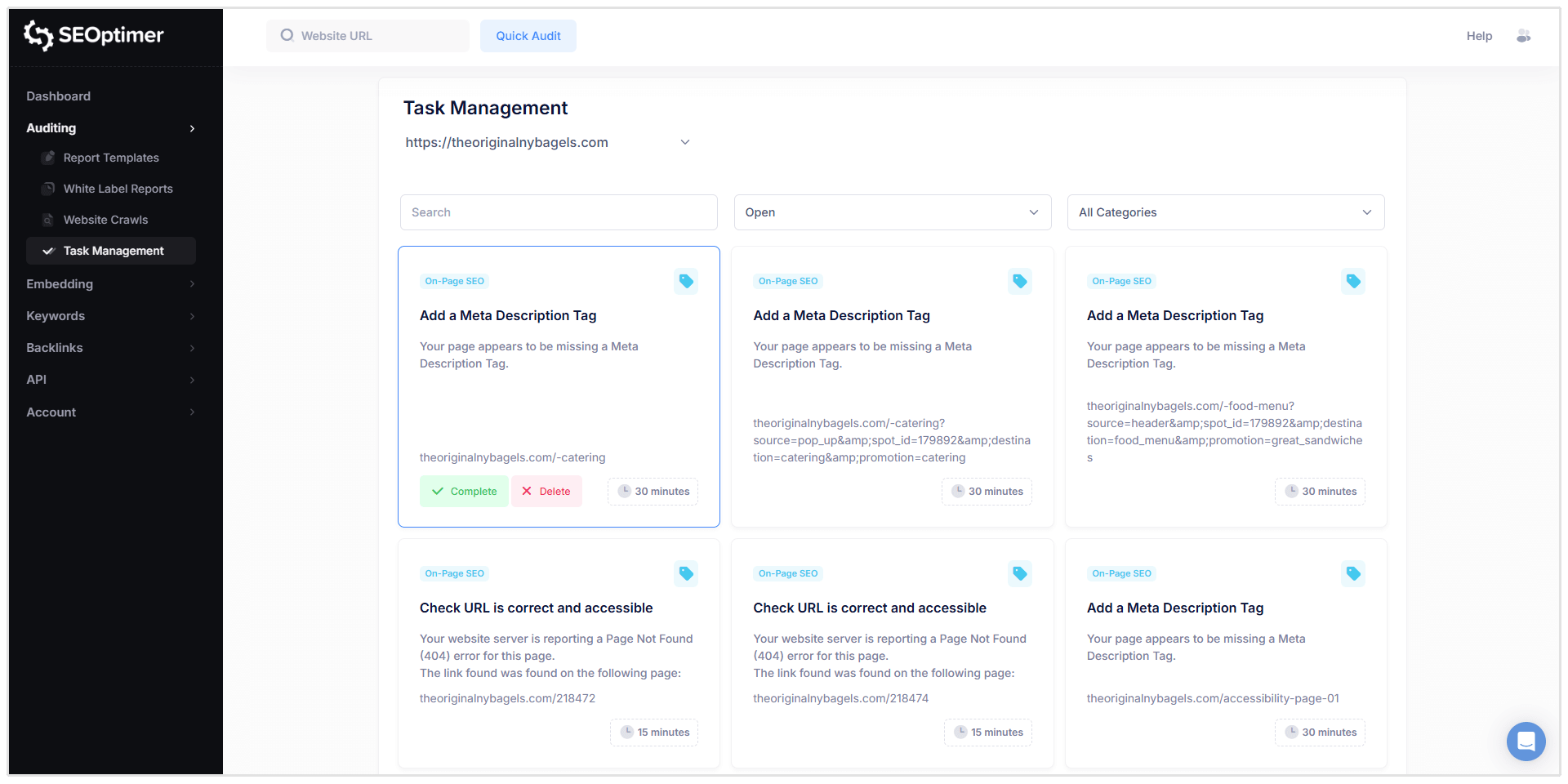

Efter at have gennemført en hjemmeside-gennemgang, kan du bruge SEOptimer’s Opgavestyringsfunktion til at organisere og spore de [issues] identificeret i din gennemgangsrapport.

"Opgavehåndteringsværktøjet" konverterer "crawlproblemer" til en "opgaveliste", som du kan arbejde igennem i et enkelt arbejdsområde, hvilket gør det lettere at prioritere rettelser og følge fremskridt over tid.

Hvordan man får adgang til "Task List"

Du kan åbne din opgaveliste på to måder:

- Klik på den blå “Se opgaver”-knap i Crawl-rapportens header.

- Eller vælg Opgavestyring fra navigationsmenuen til venstre i dit dashboard.

Bemærk: Hvis du har crawlet flere websites, kan du skifte mellem opgavelister ved at bruge rullemenuen øverst på siden til opgavestyring.

Filtrering og Administration af Opgaver

Opgaver kan filtreres efter:

- Status (Åben, Fuldført, Slettet)

- Kategori (f.eks. On-Page SEO, Links, osv.)

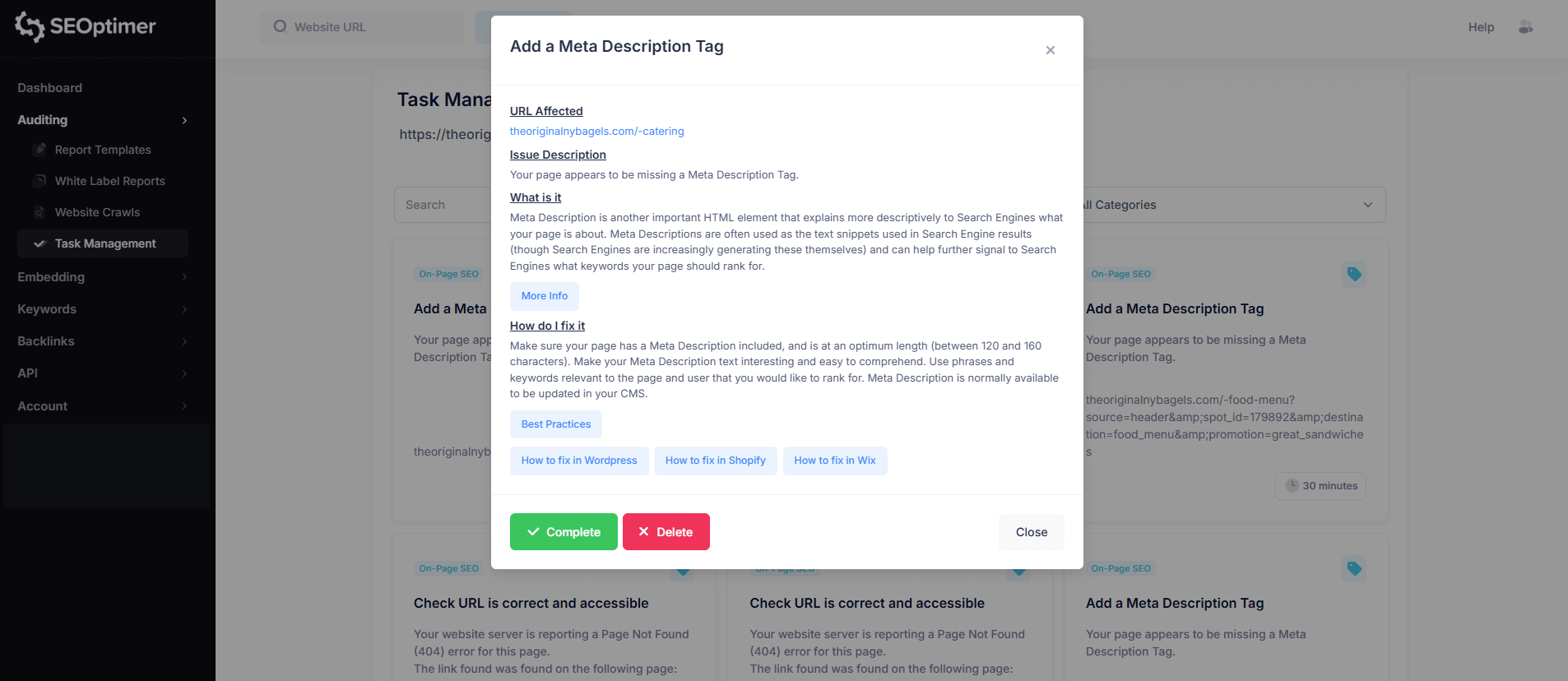

Når du klikker på en opgave, vil du se detaljerede oplysninger svarende til crawl-rapporten, inklusive:

- Berørt URL

- "Problembeskrivelse"

- Hvad problemet betyder

- "Sådan løses det"

- Muligheder for at fuldføre opgaven eller slette den fra opgavelisten

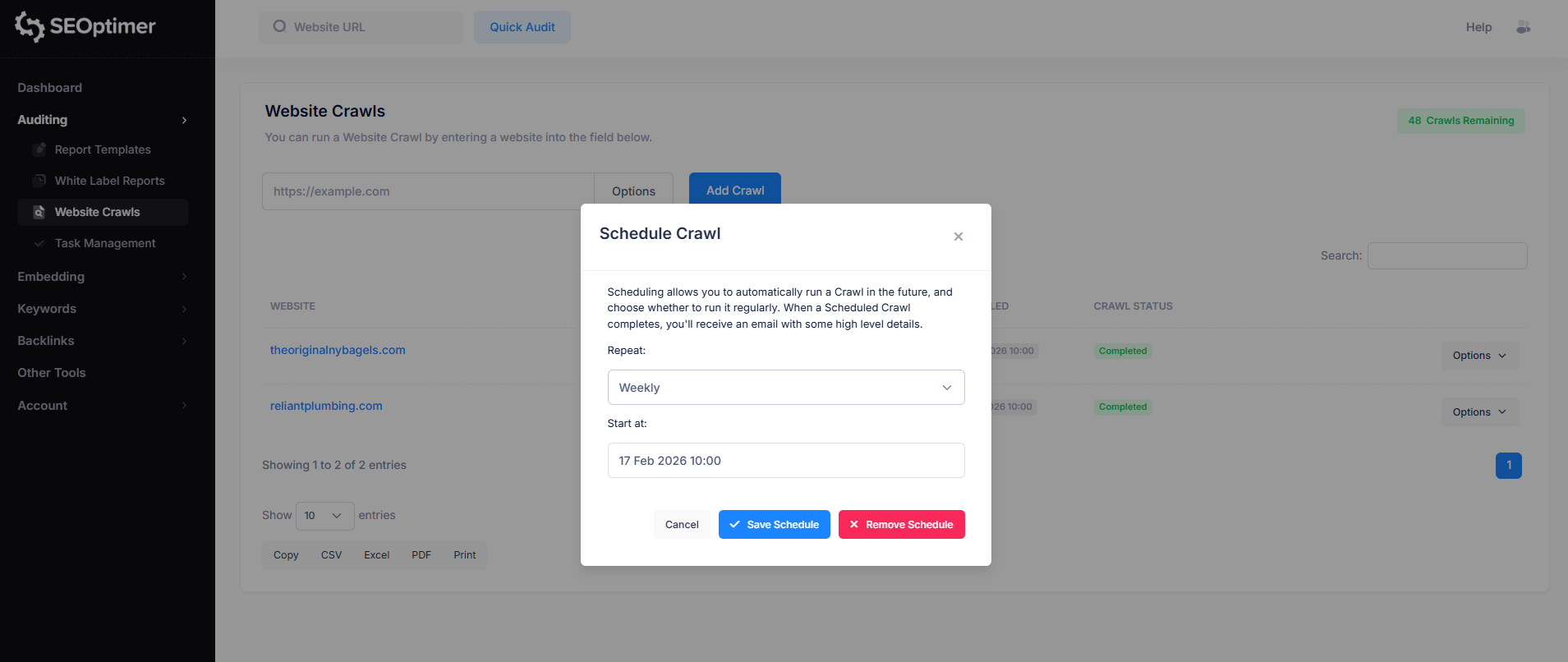

Hvordan man "planlægger" [gennemgange]

Du har også mulighed for at planlægge "crawls" til at køre på ugentlig eller månedlig basis. Denne funktion er især nyttig for bureauer, der administrerer flere klientwebsteder.

For at opsætte en crawlplan skal du blot klikke på “Indstillinger”-knappen til højre for den hjemmeside, du vil planlægge en crawl for.

Derefter skal du klikke på “Plan”-muligheden og tilpasse crawl-planen i henhold til dine præferencer.

Når en planlagt gennemgang er fuldført, vil du modtage en e-mail med nogle "høj-niveau" detaljer.

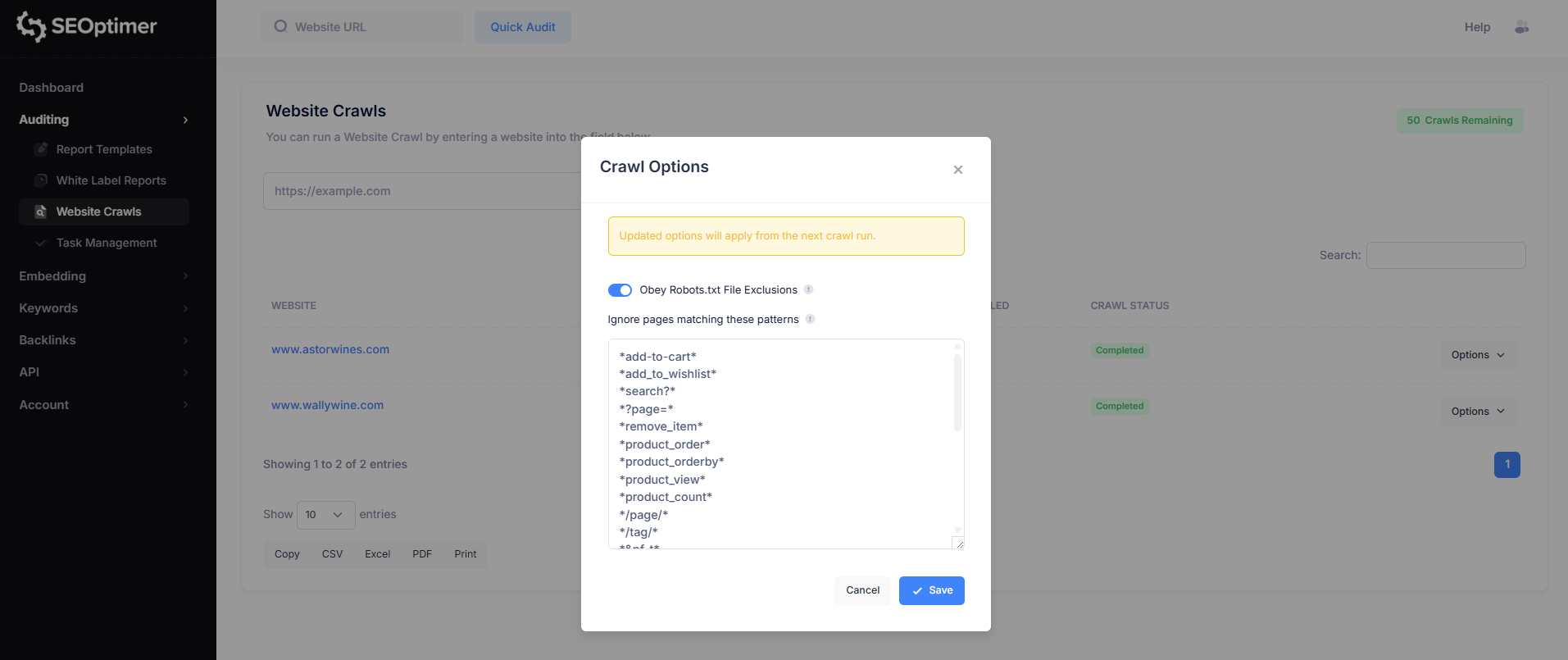

Indstilling dine egne "Crawl Rules"

Den "SEO Crawler" inkluderer "crawl"-konfigurationsmuligheder, der lader dig kontrollere, hvilke sider der er inkluderet i en "crawl".

Denne indstillinger er nyttige, hvis du ønsker at begrænse resultaterne, undgå dublerede URL'er eller sikre, at crawleren opfører sig i overensstemmelse med din sides indekseringsregler.

Adlyd Robots.txt Udelukkelser

Som standard kan crawleren følge de regler, der er defineret i din sites robots.txt-fil. Dette bestemmer, om crawleren skal undgå at scanne sider, der er markeret som "ikke tilladt".

- Aktiveret (anbefalet): "Crawleren vil respektere robots.txt udelukkelser og springe over blokerede sider."

- Deaktiveret: "Crawleren vil ignorere robots.txt reglerne og forsøge at gennemgå alle sider, den kan få adgang til."

I de fleste tilfælde anbefales det at overholde robots.txt, især når der køres crawl på [live] produktionssider.

Ignorer sider, der matcher disse mønstre

Nogle websites genererer flere versioner af den samme side ved hjælp af URL-parametre (for eksempel, sortering, filtrering, paginering eller sporingskoder).

Dette er især almindeligt på "ecommerce" hjemmesider.

Muligheden “Ignorer sider, der matcher disse mønstre” giver dig mulighed for at udelukke disse dublerede eller lavværdi-URL'er fra at blive crawlet. Dette hjælper med at holde crawl-resultaterne renere og gør det lettere at gennemgå problembeskrivelser.

Dette er en mere avanceret funktion og er primært nyttig for websites med et stort antal parameter-baserede URL'er.

SEOptimer inkluderer et standard sæt af ekskluderingsmønstre til at filtrere "almindelige parameterbaserede" dubletter fra, men du kan tilføje dine egne regler, hvis det er nødvendigt.

Disse mønstre følger standard "robots.txt" matchende syntaks.

Hvis du ikke er bekendt med reglerne for robots.txt eller URL-mønster matching, anbefales det at gennemgå "grundlæggende" før tilføjelse af "tilpassede crawl-udelukkelser". Forkerte mønstre kan forhindre vigtige sider i at blive crawlet.

Her er nogle få nyttige referencer:

- Robots.txt - Den Ultimative Guide

- Introduktion og guide til Robots.txt | Google Søgecentral

- Hvordan Google fortolker "robots.txt"-specifikationen

- Robots.txt [Syntaks]

Hvordan man eksporterer crawl-data

Hver tabel i "SEO Crawler" rapporten inkluderer indbyggede eksportmuligheder, der giver dig mulighed for at downloade eller dele crawlresultater uden for platformen.

På bunden af hver tabel vil du se eksportknapper, der lader dig [output] "data" i forskellige formater:

- CSV: Download tabellen som en .csv-fil (nyttig til regneark og databehandling).

- Excel: Eksporter tabellen som en Excel-fil til rapportering eller yderligere analyse.

- PDF: Generer en PDF-version af tabellen til deling eller dokumentation.

- Print: Åbn en udskriftsvenlig version af tabellen.

Eksport gælder for den specifikke tabel, du ser, hvilket gør det nemt at downloade "issue lists", "page reports" eller filtrerede resultater efter behov.

Afslutning

SEOptimer’s SEO Crawler gør det nemt at identificere tekniske og on-page SEO-problemer på tværs af hele din hjemmeside i en enkelt crawl.

Ved at gennemgå crawl-rapporten og bruge den indbyggede opgaveliste, kan du hurtigt omsætte crawl-fund til "handlingsrettede forbedringer".

For "bedste" [resultater], overvej at [planlægge] "regelmæssige" [gennemgange] for at overvåge ændringer over tid og opdage nye problemer, efterhånden som din "webside" vokser.

Brug for hjælp?

"Live Chat": Klik på "Live Chat" (nederste højre hjørne)

"Email": [email protected]

Responstid: Inden for 24 timer